作者:@0xwhrrari

编译:Peggy,BlockBeats

编者按:本文介绍了一种在 Polymarket 上识别套利机会并将其系统化执行的方法:用 Perplexity 完成研究,定位数据与市场定价之间的偏差;用 Claude 搭建交易逻辑、控制风险并自动执行;最终在 Polymarket 完成交易与变现。

作者的核心判断在于,盈利来自「被结构化的信息差」。市场价格更多反映群体直觉,而数据(如天气预测)提供的是概率分布。当两者出现错位,并被系统持续捕捉,就可以转化为稳定的交易机会。Claude 是大脑,Polymarket 是钱包,而 Perplexity,是眼睛,三者协同,构成一个完整的套利闭环。

这一模式一方面降低了进入门槛,使个人也能具备接近「团队级」的能力;另一方面也抬高了竞争标准。研究、分析与执行被压缩为一条连续链路后,单纯依赖经验或手动操作,将越来越难以与系统化策略竞争。

对普通参与者而言,更现实的路径在于,先通过研究找到确定性,再借助系统放大收益。谁能更早跑通这套方法,谁就更有可能在这些看似简单的市场中,持续获得稳定回报。

以下为原文:

在 Polymarket 的前 20 名顶级交易者中,有 14 个其实是机器人。一位基于 Claude 的智能体,在 48 小时内把 1,000 美元变成了 14,216 美元;而另一位基于 OpenClaw 的智能体,却在同样的时间、同样的平台上被清算归零。

差别不在代码质量,而在准备程度。

一个智能体只是被喂了一个通用 prompt,被告知「去 Polymarket 交易」;而另一个背后,则是一整套完整的研究体系:该交易哪个细分赛道、谁已经在盈利、数据从哪里来、以及背后的数学逻辑如何成立。

Perplexity AI 负责研究,Claude 负责编码,而 Polymarket 负责支付回报。

这是完整的拆解,建议收藏。

你可以试试:

- Perplexity:perplexity.ai

- 策略查看:polymarket.com

- 跟单机器人:t.me/PolyGunSniperBot

- Telegram 频道:rari lr

研究层:10 分钟内从零到策略

Polymarket 上有几十个交易类别:政治、加密、体育、天气。大多数人凭感觉选择,这正是亏钱的开始。

只需一次深度研究查询,Perplexity 就能在不到 3 分钟内扫过 47+ 个信息源:包括 Polymarket 的 API 文档、交易者在 Reddit 上分享盈亏截图的帖子、以及拆解钱包行为的 Twitter 分析。

更重要的是,每一个结论都附带引用和来源链接——不是没有凭证的原始文本,而是可以点击、可以核查的「可验证数据」。

拆解几乎是立刻得出的:

BTC 5 分钟市场:套利窗口只有 2.7 秒,这是高频交易(HFT)的领域。你需要机房共址服务器和至少六位数的资金预算。

体育套利:利润空间通常在 1–3% 之间,至少需要 5,000 美元以上的本金,才值得承担执行风险。

天气市场:利润空间高出 3–4 倍,100 美元即可入场。大多数参与者是基于直觉定价的散户。

在第一次回答之后,Perplexity AI 还会主动给出后续研究问题建议:

「要不要对比 NOAA 和其他天气预报提供商?」——要

「要不要看看 Polymarket 的费用结构?」——要

「不同时间跨度下天气预测的历史准确率如何?」——要

它进一步挖出了多个交易钱包画像(Profile)。系统甚至自动提取出了 API 中不存在的数据:入场时机模式、平均仓位规模、交易频率分布。这类分析,如果靠人工去逐个追踪钱包,一个初级分析师可能需要整整一天。

而这几个钱包的共性非常清晰:完全自动化、全天候 24/7 运行、零情绪决策。没有人坐在电脑前点鼠标——这些机器人是基于数学在交易。

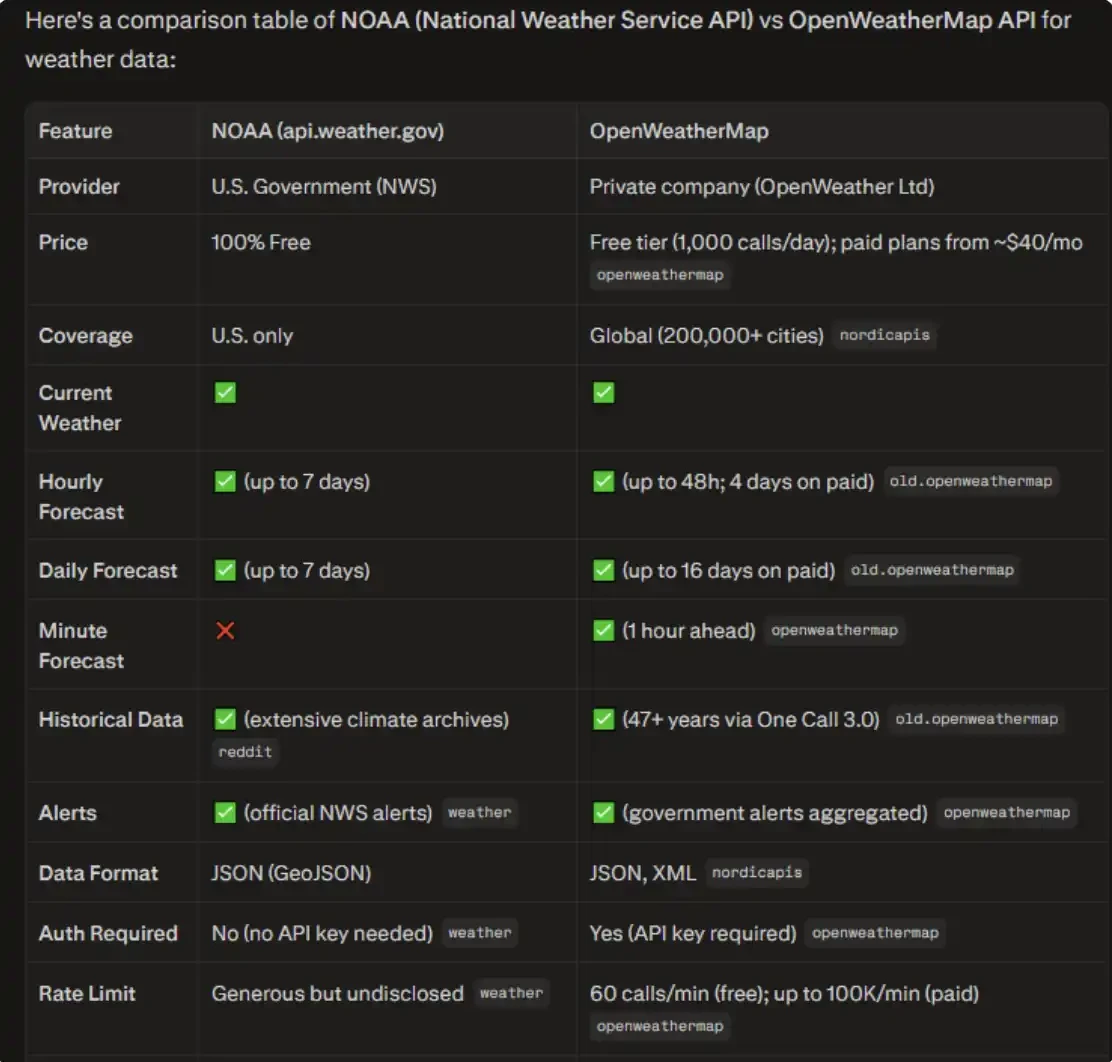

第三个查询则进一步聚焦:美国天气市场最优的数据源是什么?

Perplexity 对比了 NOAA、OpenWeatherMap 和 AccuWeather,从准确率、成本、更新频率以及 API 可用性等多个维度进行了系统评估。

NOAA 在所有真正关键的指标上都胜出。免费、24—48 小时预报准确率达 94%、基于数十年的卫星数据与超级计算机建模、每小时更新、开放 API,且在合理使用范围内几乎没有速率限制。

只用了三次查询、十分钟时间,就拿到了一张完整的策略地图:该做哪个细分市场、谁已经在盈利、数据源在哪里。

如果没有 Perplexity,同样的研究往往要花上 4 到 5 个小时,在 Twitter、Reddit、各类文档页面和学术论文之间来回翻找,而且还不能保证你真的能找到对的来源。

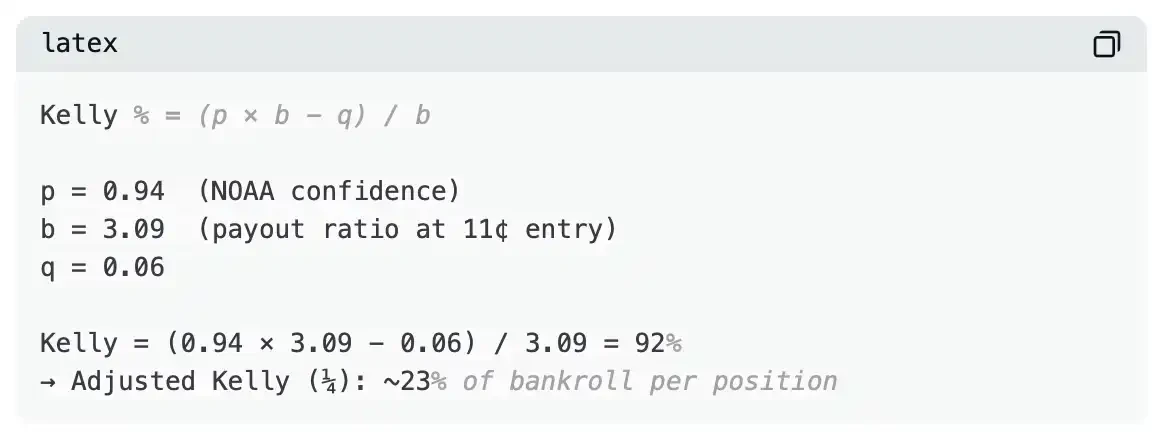

优势背后的数学逻辑

Polymarket 的气温市场是二元市场:「本周六纽约气温会不会高于 72°F?」答案只有两个:会,或者不会。最终结算要么是 1 美元,要么是 0 美元。

但给这些市场定价的人是谁?是散户。他们会看手机上的天气 App,可能再顺手瞄一眼 7 天天气预报。他们不会去调 NOAA 的概率分布数据。

结果就是:NOAA 给出某个温度区间 94% 的概率置信度,市场却只给它定价 11 美分。

这就是数据所显示的结果,与市场群体认知之间存在的结构性错位。

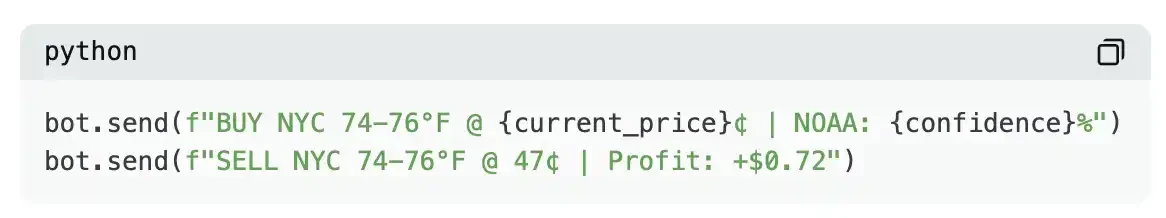

比如,NOAA 认为纽约周六落在 74–76°F 区间的概率是 94%,而 Polymarket 上这个区间的价格只有 11 美分。于是机器人在 11 美分买入。随着更多信息在接下来的几个小时内逐步被市场消化,价格上涨到 45–60 美分。机器人在 47 美分卖出。每股利润:+36 美分。

如果在一个 2 美元的仓位上操作,收益就是 +6.50 美元。一天跑 10 笔这样的交易,就是 65 美元。

单笔交易看起来并不惊人。真正让人兴奋的,是规模化之后的结果。

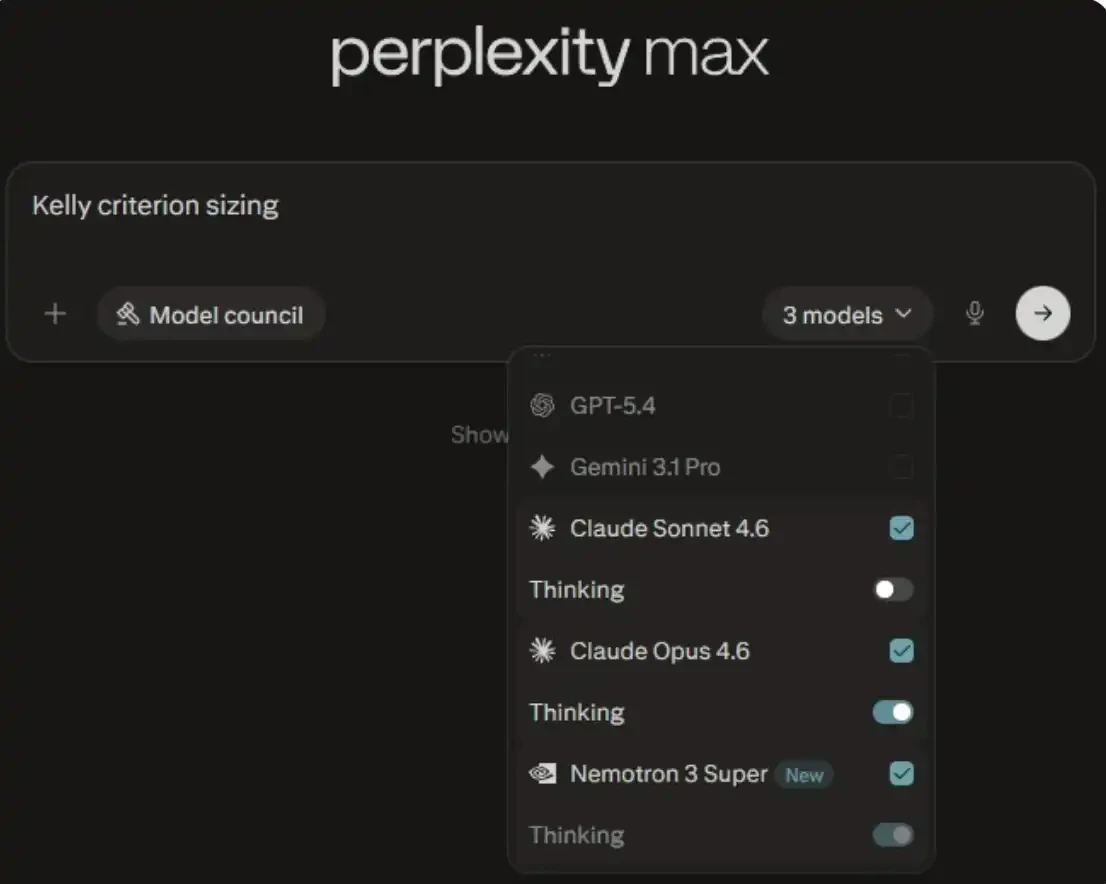

这也是为什么 Perplexity 的 model council 很重要。关于「最优仓位规模」的那个查询,并不是由单一模型处理的——而是同时交给 Claude、GPT 和 Gemini 并行运行。

最终给出的答案,并不是某一个模型的「观点」,而是三个大模型共同收敛后的结果。

当 Claude、GPT 和 Gemini 在独立计算后,对同一个 Kelly 仓位比例得出一致结论时,这已经不再是可能的「幻觉输出」,而是一个经过交叉验证的结果。

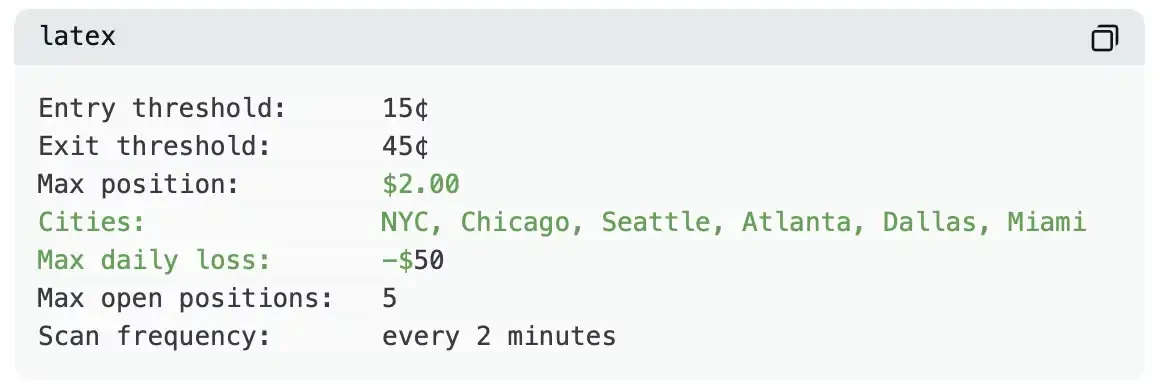

在实际操作中,如果本金只有 100 美元,每个仓位最多不应超过 2 美元。

保守吗?当然保守。但 NOAA 仍有大约 6% 的出错概率。若没有合适的仓位控制,一笔错误交易就足以吞掉当天的全部利润。6 个城市、每个城市 10 多个温度区间——这意味着每天都有 60 多个市场可供扫描。

Perplexity 的多源分析又进一步汇总了三项独立的气象研究,确认 NOAA 在 24 小时内 94% 的预测准确率其实已经算是偏保守的估计——对于气象站覆盖更密集的核心大都市区,准确率往往还会更高。

而这个机器人每 2 分钟扫描一次市场。按此计算,它每天会对 60 多个市场完成 720 次扫描。这种覆盖强度,人类根本无法持续做到。

Claude 作为「大脑」

整个系统分为三个模块:扫描器、解析器、执行器。

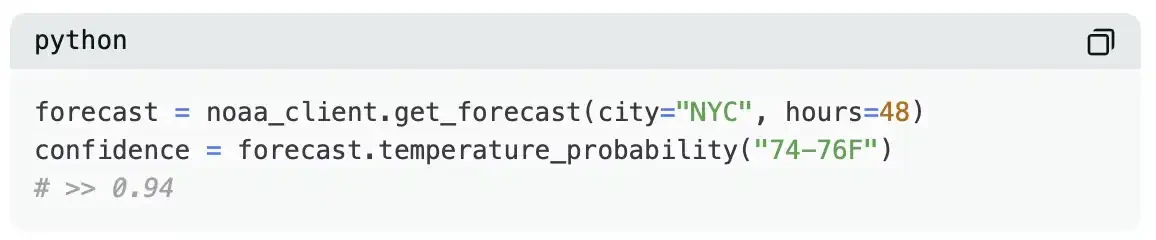

NOAA 扫描器:

Polymarket 解析器(Parser):

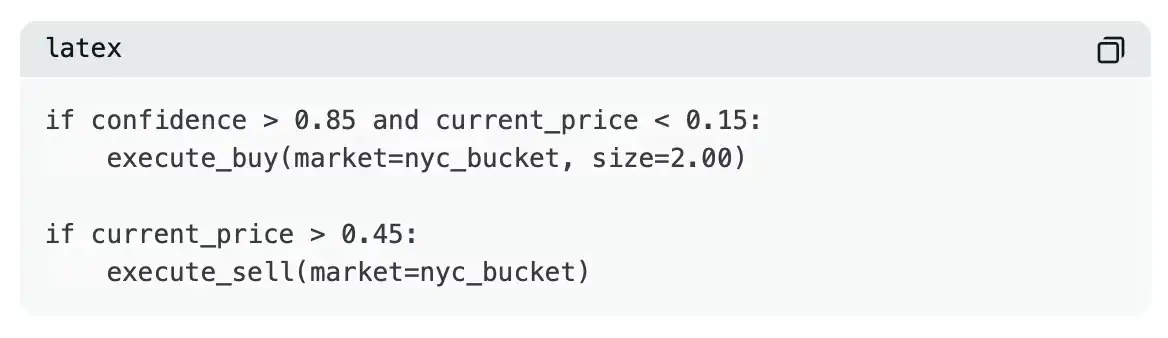

决策逻辑(Decision Logic):

Telegram 报告模块(Reports):

一个普通脚本只会执行 if/then 逻辑:条件满足 → 买入。就这么简单。而一个基于 Claude 的智能体,会读取「上下文」。

比如,飓风正在逼近?原本每小时更新一次的 NOAA 数据,变成每 30 分钟更新一次。智能体会识别到预测的不稳定性在上升,并自动降低仓位规模。它还会读取新闻流、监控 Twitter 上的情绪变化、交叉验证多个数据源——在真正下单之前,动态调整自己的置信度。

这就是计算器和分析师之间的区别。

以 15 美分入场、NOAA 置信度高于 85%,意味着真实概率与市场定价之间至少存在 5.6 倍的错位。

在 45 美分退出,则可以在每一笔成功交易中锁定 3 倍收益。

将每日亏损上限设为 50 美元,意味着最糟糕的一天最多损失一半本金——随后机器人会自动停机,等到第二天再继续运行。

系统堆栈(The Stack)

Perplexity AI 解决的是研究层的缺口:细分市场选择、数据来源定位、数学验证、风险评估——全部基于可验证的引用与来源。

Claude 解决的是执行层的缺口:代码生成、逻辑实现,以及实时的自适应决策。

Polymarket 则是变现层。

为什么 Perplexity 是不对称优势

大多数人都会低估「研究」这一步。他们直接跳到写代码、直接执行策略——然后困惑为什么机器人第一天就开始亏钱。

Perplexity 不是一个套着聊天界面的搜索引擎,它本质上是一套研究基础设施。

多模型共识机制

你的查询不是交给一个模型,而是同时运行在 Claude、GPT、Gemini 上。当三个模型独立得出一致答案时,你面对的就不再是「可能的幻觉」,而是一个被交叉验证过的信号。

所有结论都有引用

每一个判断都能回溯到来源。不是「我觉得 NOAA 准确率是 94%」,而是:这里有研究论文、API 文档、还有交易者用真实盈亏验证的 Reddit 讨论。你可以逐条点击核查。

Deep Research 的深度

在不到 3 分钟内解析 47+ 个信息源:学术论文、API 文档、交易论坛、Twitter 数据分析。输出的不是一堆链接,而是可以直接执行的策略。

后续问题的自动生成

它不仅回答问题,还会告诉你下一步该问什么:「要不要比较不同预报源?」「要不要拆解费用结构?」它在替你构建完整的研究路径。

速度带来的复利效应

10 分钟的研究,替代 4–5 小时的人工检索。这不是便利性提升,而是结构性优势。当别人还在刷 Reddit 时,你的机器人已经开始运行并产生收益。

Claude 是大脑;Polymarket 是钱包;而 Perplexity,是眼睛。

没有它,你是在盲目交易;有了它,你在下注之前,已经看清了整个棋盘。

研究层 → 策略层 → 执行层 → 收益,Perplexity 是第一步。而第一步,恰恰是 90% 交易者失败的地方。

不要跳过。

大多数人读完这些,会点点头,然后继续手动交易。而真正行动的人,此刻已经在另一个标签页打开 Perplexity,跑起了第一条 Deep Research 查询:细分市场、盈利钱包、数据来源、Kelly 仓位……

从「知道」到「做到」的距离,不过是一条 prompt。

等你在某个天气市场赚到第一笔 6.50 美元,再回来看这篇内容——你会有完全不同的理解。