作者:郭曉靜

來源:騰訊新聞

2017 年,一篇具有里程碑意義的論文——《Attention is All You Need》橫空出世,它首次引入了基於自註意力機制的Transformer 模型,這一創新架構擺脫了傳統的RNN 和CNN 的束縛,透過平行處理的注意力機制,有效克服了長距離依賴的難題,並顯著提升了序列資料處理的速度。 Transformer 的編碼器- 解碼器結構和多頭注意力機制在人工智慧領域掀起了一場風暴,大熱的ChatGPT 正是基於這一架構構建的。

想像一下,Transformer 模型就像是你的大腦在和朋友交談時,能夠同時關注對方說的每個詞,並理解這些詞之間的聯繫。它賦予了電腦類似人類的語言理解能力。在此之前,RNN 是處理語言的主流方法,但其資訊處理速度緩慢,就像老式的磁帶播放器,必須逐字逐句地播放。而Transformer 模型則像是高效能的DJ,能夠同時操控多個音軌,迅速捕捉關鍵訊息。

Transformer 模型的出現極大地提升了電腦處理語言的能力,使得機器翻譯、語音識別和文字摘要等任務變得更加高效和精確,這對整個行業來說是一個巨大的飛躍。

這項創新成果源自於八位曾在Google工作的AI 科學家的共同努力。他們最初的目標非常簡單:改進Google的機器翻譯服務。他們希望機器能夠完整地理解並通讀整個句子,而不是孤立地逐詞翻譯。這個理念成為了「Transformer」架構的起點——「自我注意力」機制。在此基礎上,這八位作者發揮各自的專長,於2017 年12 月發表了論文《Attention Is All You Need》,詳細描述了Transformer 架構,開啟了生成式AI 的新篇章。

在生成式AI 的世界裡,規模定律(Scaling Law)才是核心原則。簡而言之,隨著Transformer 模型規模的擴大,其效能也隨之提升,但這同樣意味著需要更強大的運算資源來支援更龐大的模型和更深層的網絡,而提供高效能運算服務的英偉達也同時成為了這場AI 浪潮中的關鍵角色。

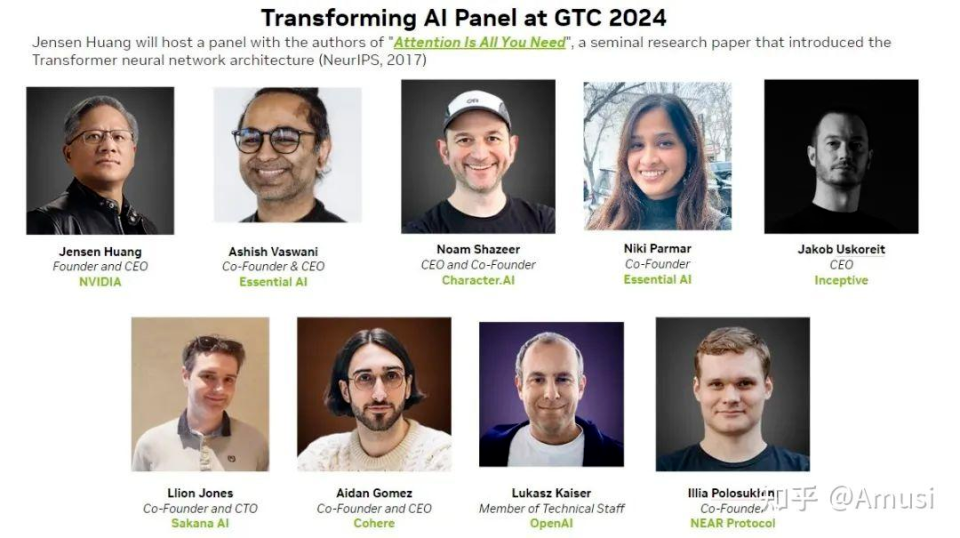

在今年的GTC 大會上,英偉達的黃仁勳以一種充滿儀式感的方式邀請了Transformer 的七位作者(Niki Parmar 因故臨時未能出席)參與圓桌論壇的討論,這是七位作者首次在公開場合集體亮相。

他們在對話中也表達了一些令人印象深刻的觀點:

這個世界需要比Transformer 更好的東西,我想我們在座的所有人都希望它能被某些東西取代,將我們帶到一個新的性能高原。

我們在最初的目標上並沒有成功,我們開始Transformer 的初衷是想要模擬Token 的演化過程。它不僅僅是線性的生成過程,而是文字或程式碼的逐步演化。

像2+2 這樣的簡單問題,它可能會使用大模型的萬億參數資源。我認為自適應計算是接下來必須出現的事情之一,我們知道在特定問題上應該花費多少計算資源。

我認為目前的模型太過經濟實惠,規模也太小,大概1 美元百萬toke 的價格,比外出購買一本平裝書要便宜100 倍。

以下為內容實錄:

黃仁勳:在過去的六十年中,電腦科技似乎沒有經歷根本性的變革,至少從我出生的那一刻起便是如此。我們目前所使用的電腦系統,無論是多工處理、硬體與軟體的分離、軟體的兼容性,或是資料備份能力,以及軟體工程師的程式設計技巧,基本上都是基於IBM System360的設計原則——中央處理器、Bio子系統、多工處理、硬體與軟體、軟體系統的相容性等等。

我認為,自1964年以來,現代計算並沒發生根本性改變。儘管在20世紀的80年代和90年代,電腦經歷了重大的轉型,形成了今天我們所熟悉的形態。但隨著時間的流逝,電腦的邊際成本持續下降,每十年其成本減少十倍,十五年減少一千倍,二十年減少一萬倍。在這場電腦革命中,成本的降低幅度是如此之大,以至於在二十年的時間裡,電腦的成本幾乎降低了一萬倍,這種變化為社會帶來了巨大的動力。

試著想像一下,如果你生活中所有昂貴的物品都降到了原來的一萬分之一,比如二十年前你花20萬美元購買的汽車,現在只需1美元,你能想像這種變化嗎?然而,電腦成本的下降並非一蹴而就,而是逐漸到達了一個臨界點,之後成本下降趨勢突然停止了,它依然每年都在不斷改進一點點,但是變化率停滯不變了。

我們開始探索加速運算,但使用加速運算並不容易,你需要從頭一點一點來設計。過去,我們可能會按照既定的步驟一步一步解決問題,但現在,我們需要重新設計這些步驟,這是一個全新的科學領域,將先前的規則重新表述為平行演算法。

我們體認到這一點,並相信,如果我們能夠加速哪怕是1%的程式碼,節省99%的運行時間,那麼一定會有應用程式能夠從中受益。我們的目標是讓不可能變成可能,或將可能變成不可能,或已經可能的事情變得更有效率,這就是加速運算的意義。

回顧公司的歷史,我們發現我們有能力加速各種應用。起初,我們在遊戲領域取得了顯著的加速效果,效果好到讓人誤以為我們是一家遊戲公司。但實際上,我們的目標遠不止於此,因為這個市場龐大,大到能夠推動難以置信的技術進步。這種情況並不常見,但我們找到了這樣一個特例。

長話短說,2012年,AlexNet點燃了星星之火,這是人工智慧與英偉達GPU的首次碰撞。這標誌著我們在這一領域的神奇旅程的開始。幾年後,我們發現了一個完美的應用場景,為我們今天的發展奠定了基礎。

簡而言之,這些成就為生成式人工智慧的發展奠定了基礎。生成式AI不僅能辨識圖片,還能將文字轉換為圖片,甚至創造出全新的內容。現在,我們有了足夠的技術能力去理解像素,辨識它們,並理解它們背後的意義。透過這些背後的意義,我們可以創造出新的內容。人工智慧透過數據理解其背後意義的能力,這是一個巨大的變革。

我們有理由相信,這是一場全新的工業革命的開始。在這場革命中,我們正在創造前所未有的東西。例如,在先前的工業革命中,水是能源的來源,水進入我們創造的裝置,發電機開始工作,進水、出電,如同魔法一樣。

生成式AI,是一種全新的“軟體”,它又能夠創造軟體,它依賴眾多科學家的共同努力。想像一下,你給AI原料——數據,它們進入一棟「建築」——我們稱為GPU的機器,它就能輸出神奇的結果。它正在重塑一切,我們正在見證「AI工廠」的誕生。

這種變革可以被稱為全新的工業革命。在過去,我們從未真正經歷過這樣的變革,但現在,它正緩緩展開在我們面前。不要錯過接下來的十年,因為在這十年裡,我們將創造出巨大的生產力。時間的鐘擺已經啟動,我們的研究人員已經開始行動。

今天我們邀請了Tansformer的創造者們,來一起討論未來生成式AI會帶我們到哪裡去。

他們是:

Ashish Vaswani: 2016年加入Google大腦團隊。 2022年4月,與Niki Parmar共同創辦了Adept AI,同年12月離開該公司,並共同創立了另一家人工智慧新創公司Essential AI。

Niki Parmar:在Google大腦工作了四年,之後與Ashish Vaswani共同創立了Adept AI和Essential AI。

Jakob Uszkoreit: 2008年至2021年在Google工作。 2021年離開谷歌,並與他人共同創立Inceptive,該公司主要業務為人工智慧生命科學,致力於使用神經網路和高通量實驗來設計下一代RNA分子。

Illia Polosukhin: 2014年加入Google,是八人團隊中最早離開的人之一,於2017年與他人共同創立了區塊鏈公司NEAR Protocol。

Noam Shazeer:曾於2000年至2009年間和2012年至2021年期間就職於Google。 2021年,Shazeer離開Google並與前Google工程師Daniel De Freitas共同創立Character.AI。

Llion Jones:曾工作於Delcam、YouTube。 2012年加入谷歌,擔任軟體工程師。後來離開谷歌,創辦人工智慧新創公司sakana.ai。

Lukasz Kaiser:曾任法國國家科學研究中心研究員。 2013年加入Google。 2021年,他離開谷歌,成為OpenAI的研究員。

Aidan Gomez:畢業於加拿大多倫多大學,Transformer論文發表時,他還是Google大腦團隊的實習生。他是八人團隊中第二個離開Google的人。 2019年,他與他人共同創立了Cohere。

黃仁勳:今天坐到這裡,請大家積極爭搶發言的機會,在這裡沒有什麼話題是不可以談的,你們甚至可以從椅子上跳起來去討論問題。讓我們從最基礎的問題談起,你們當時遇到了什麼問題,是什麼啟發你們去做Transformer?

Illia Polosukhin:如果你想要發布能夠真正讀取搜尋結果的模型,例如處理成堆的文檔,你需要一些能夠迅速處理這些資訊的模型。當時的遞歸神經網路(RNN)並不能滿足這樣的需求。

確實,那時雖然有遞歸神經網路(RNN)和一些初步的注意力機制(Arnens)引起了關注,但它們仍然需要逐個單字地閱讀,效率不高。

Jakob Uszkoreit:我們產生訓練資料的速度遠遠超過了我們訓練最先進架構的能力。實際上我們使用的是更簡單的架構,例如以n-gram作為輸入特徵的前饋網路。這些架構至少在Google規模的大量訓練資料中,由於訓練速度更快,通常都能超越那些更複雜、更先進的模型。

那時候的強大RNN,特別是長短期記憶網絡(LSTM),已經存在。

Noam Shazeer:看起來這是一個亟待解決的問題。我們在2015年左右就已經開始注意到這些Scaling law,你可以看到隨著模型規模的增大,它的智慧程度也隨之提高。這裡就像是世界歷史上最好的問題,非常簡單:你只是在預測下一個token,它就會變得如此聰明,能夠做一百萬個不同的事情,你只是想擴大規模並讓它變得更好。

而一個巨大的挫敗感在於,RNN處理起來實在是太麻煩了。然後我偶然聽到這些傢伙在討論,嘿,讓我們用卷積或註意力機制來取代它。我心想,太好了,我們就這麼做。我喜歡把Tansformer比喻為是從蒸汽機到內燃機的飛躍。我們本來可以用蒸汽機完成工業革命,但那將會非常痛苦,而內燃機讓一切都變得更好。

Ashish Vaswani:我在研究生時期就開始體會到一些苦澀的教訓,尤其是在我從事機器翻譯工作的時候。我意識到,嘿,我不會去學習那些複雜的語言規則。我認為梯度下降(Gradient Descent)——我們訓練這些模型的方法——是一個比我更出色的老師。所以我不會去學習這些規則,我只會讓梯度下降(Gradient Descent)為我完成所有工作,這就是我的第二個教訓。

我從這些苦澀的教訓中學到的是,那些可以擴展的通用架構最終將在長期中勝出。今天可能是token,明天可能是我們在電腦上採取的行動,它們將開始模仿我們的活動,並能夠自動化我們所做的許多工作。正如我們所討論的,Transformer特別是其自註意力機制,具有非常廣泛的適用性,它也讓梯度下降變得更好。另外就是物理學,因為我從Noam學到的一點是,矩陣乘法是個好主意。

Noam Shazeer:這個模式一直在重複出現。所以每次當你增加一堆規則時,梯度下降終將比你更擅長學習這些規則。就是這樣。就像我們一直在做的深度學習一樣,我們正在建立一個形狀像GPU的AI模型。而現在,我們正在建立一個形狀像超級電腦的AI模型。是的,超級電腦現在就是模型。是的,這是真的。是的。超級電腦只是為了讓你們知道,我們正在建造超級計算機,使其成為模型的形狀。

黃仁勳:所以你們要解決什麼問題?

Lukasz Kaiser:機器翻譯。回想五年前,這個過程似乎非常艱難,你得蒐集數據,可能進行翻譯,但結果可能只是勉強正確。那時的水平還很基礎。但現在,這些模型即使沒有數據也能學會翻譯。你只需提供一種語言和另一種語言,模型就能自行學會翻譯,這種能力就像自然而然地湧現出來的,而且效果令人滿意。

Llion Jones:但是,「Attention」的直覺就是你所需要的。所以我想出了這個標題,基本上發生的事情就是在我們尋找標題的時候。

我們只是在做消融,開始把模型的一些碎片丟掉,只是為了看看它會不會變得更糟。令我們驚訝的是,它開始變得更好。包括像這樣丟掉所有的捲積效果要好得多。所以這就是標題的來源。

Ashish Vaswani:基本上有趣的是,我們實際上是從一個最基本的框架開始的,然後我們添加了東西,我們添加了卷積,我猜後來我們又把它們去掉了。還有多頭注意力等其他很多非常重要的東西。

黃仁勳:誰想出了Transformer的名字?為什麼叫Transformer?

Jakob Uszkoreit:我們喜歡這個名字,我們只是隨便取了一個名字,覺得它很有創意,改變了我們的數據生產模式,使用了這樣一種邏輯。所有的機器學習都是Transformer,都是顛覆者。

Noam Shazeer:我們之前沒有想過這個名字,我覺得這個名字特別簡單,很多人都覺得這個名字特別好。我之前想過很多的名字,例如Yaakov,最終確定了“Transformer”,它描述了模型的原理,它實際上轉換了整個訊號,按照這個邏輯,幾乎所有的機器學習都會被轉換。

Llion Jones:Transformer之所以成為這樣一個人們耳熟能詳的名字,不僅是因為翻譯的內容,而且是因為我們希望以更概括的方式來描述這種變革。我不覺得我們做得多麼出色,但是作為一個變革者,作為驅動和引擎,它是有邏輯的。大家能夠了解到這樣一個大語言模型、引擎和邏輯,從架構上而言,這都是一個比較早的著手時期。

但是我們確實意識到,我們實際上正在嘗試創造一些非常非常通用的東西,它真的可以將任何東西變成其他任何東西。而且我不認為我們預測到當Transformer被用於圖像時,這實際上會有多好,這有點令人驚訝。這對你們來說可能是合乎邏輯的,但事實上,你可以將圖像分塊並標記每個小點,對吧。我認為這在建築上很早就存在了。

因此,當我們建立張量到張量庫時,我們真正關注的是擴大自回歸訓練的規模。這不僅僅是語言,還有圖像、音訊的組件。

所以盧卡什(Lukasz)說他正在做的是翻譯。我想他是低估了自己,所有這些想法,我們現在開始看到這些模式結合在一起,它們都加入了模型。

但實際上,一切都很早就存在了,這些想法正在滲透,這需要一些時間。盧卡什(Lukasz)的目標是我們擁有所有這些學術數據集,它們從圖像到文本,從文本到圖像,從音頻到文本,從文本到文本。我們應該對一切進行訓練。

這個想法確實推動了擴展工作,最終成功了,它是如此有趣,以至於我們可以將圖像翻譯成文本,將文本翻譯成圖像,翻譯文本到文本。

你正在用它來研究生物學,或生物軟體,它可能類似於電腦軟體,它以程式的形式開始,然後你將其編譯成可以在GPU 上運行的東西。

一個生物軟體的生命始於某些行為的規範。比如說,你想列印一個蛋白質,就像細胞中的特定蛋白質一樣。然後你學會如何使用深度學習將其轉化為RNA分子,但實際上一旦進入你的細胞,表現出這些行為。所以這個想法真的不只是翻譯成英文。

黃仁勳:你們是否創建了一個大型的實驗室來生產這一切?

Aidan Gomez:大量可用,實際上仍然公開,因為這些數據通常仍然主要由公共資助。但實際上,你仍然需要數據來清楚地說明你正在嘗試的現象。

試著在給定的產品中進行建模,比如說蛋白質表現和mRNA 疫苗之類的東西,或者是的,在帕洛阿爾托,我們有一大堆機器人和穿著實驗室外套的人,既有學習研究人員,也有以前是生物學家的人。

現在,我們認為自己是新事物的先驅,致力於實際創建這些數據並驗證設計這些分子的模型。但最初的想法就是翻譯。

黃仁勳:最初的想法是機器翻譯,我想問的是,在架構的強化和突破中,看到的關鍵節點是什麼?以及它們對Transformer的設計有什麼影響?

Aidan Gomez:一路走來,你們都看到了,你認為在基礎Transformer設計之上真的有很大的額外貢獻嗎?我認為在推理方面,已經有大量的工作來加速這些模型,使它們更有效率。

我仍然認為這有點讓我感到不安,因為我們的原始形式是多麼相似。我認為這個世界需要比Transformer更好的東西,我想我們在座的所有人都希望它能被某種東西所取代,將我們帶到一個新的性能高原。

我想問在座的每個人一個問題。你認為接下來會發生什麼事?就像這是令人興奮的一步,因為我認為它與6-7 年前的東西太相似了,對吧?

Llion Jones:是的,我想人們會驚訝於你說的相似程度,對吧?人們確實喜歡問我接下來會發生什麼,因為我是這篇論文的作者。就像魔法一樣,你揮舞魔法棒,下一步會出現什麼?我想指出的是,這個具體的原理是如何被設計出來的。我們不僅需要變得更好,我們需要變得明顯地更好。

因為如果它只是稍微好一點,那麼這還不足以將整個人工智慧產業推向新事物。因此,我們被困在原始模型上,儘管從技術上講,它可能不是我們現在擁有的最強大的東西。

但是每個人都知道自己想要什麼樣的個人工具,你們想做更好的上下文窗口,你們想要更快產生token的生成能力。好吧,我不確定你是否喜歡這個答案,但他們現在使用了太多的計算資源。我認為大家做了很多浪費的計算。我們正在努力提高效率,謝謝。

黃仁勳:我覺得我們是讓這一切更有效,感謝!

Jakob Uszkoreit:但我覺得這主要是關於如何分配資源,而不是總共消耗了多少資源。例如我們不希望在一個容易得問題上花太多錢,或是在一個太難的問題上花太少而最終得不到解決方案。

Illiya Polosukhin:這個例子就像2+2,如果你正確地將他輸入到這個模型中,它就會使用一兆個參數。所以我認為自適應計算是接下來必須出現的事情之一,我們知道在特定問題上應該花費多少計算資源。

Aidan Gomez:我們知道目前電腦的生成能力有多少,我覺得這是接下來需要集中註意力的問題,我覺得這是宇宙級的變革者,這也是未來的發展趨勢。

Lukasz Kaiser:這種概念在Transformer之前就存在了,它被整合進了Transformer模型中。實際上,我不確定在座的各位是否清楚,我們在最初的目標上並沒有成功,我們開始這個計畫的初衷是想要模擬Token的演化過程。它不僅僅是線性的生成過程,而是文字或程式碼的逐步演化。我們進行迭代,我們進行編輯,這使我們有可能不僅模仿人類如何發展文本,還能將他們作為這個過程的一部分。因為如果你能像人類一樣自然地產生內容,他們實際上就能夠提供回饋,不是嗎?

我們所有人都研究過香農的論文,我們最初的想法是,只專注於語言建模和困惑度,但事實上這並沒有實現。我認為這也是我們能夠進一步發展的地方。這也與我們現在如何智慧地組織運算資源有關,這種組織方式現在也適用於影像處理。我的意思是,擴散模型具有一種有趣的特性,它們能夠透過迭代不斷地精煉和提升品質。而我們目前還沒有這樣的能力。

我的意思是,這個根本問題:哪些知識應該內建在模型之中,哪些知識應該置於模型之外?是使用檢索模型嗎? RAG(Retrieval-Augmented Generation)模型就是一個例子。同樣地,這也涉及推理問題,即哪些推理任務應該透過外在的符號系統來完成,哪些推理任務應該直接在模型內部執行。這在很大程度上是一個關於效率的討論。我確實相信,大型模型最終會學會如何進行2+2這樣的計算,但如果你要計算2+2,卻透過累積數字來進行,那顯然是低效的。

黃仁勳:如果AI只需要計算2+2,那麼它應該直接使用計算器,用最少的能量來完成這個任務,因為我們知道計算器是做2+2計算的最有效工具。然而,如果有人問AI,你是如何得出2+2的決定的?你知道2+2是正確的答案嗎?這將耗費大量的資源?

Noam Shazeer:確實如此。你之前提到過一個例子,但我同樣確信在座的各位所研發的人工智慧系統都足夠智能,能夠主動使用計算器。

目前全球公共產品(GPP)正是這樣做的。我認為目前的模型太過經濟實惠,規模也還太小。它之所以便宜,是因為像NV這樣的技術,感謝它的產出。

每次操作的計算成本大約是10到18美元。或者說,大致在這個數量級。感謝您創造瞭如此多的運算資源。但是,如果你觀察一個擁有五千億參數的模型,並且每個token進行一萬億次計算,大概是一美元百萬token,這比外出購買一本平裝書並閱讀的成本要便宜100倍。我們的應用程式在價值上比巨型神經網路上的高效計算高出百萬倍或更多。我的意思是,它們無疑比治癒癌症等事情更有價值,但不僅如此。

Ashish Vaswani:我覺得讓世界更聰明,就是指如何去獲得來自於世界的回饋,我們能否實現多任務、多線的並行。如果你真的想建立這樣一個模型,幫助我們設計這樣一個模型,這是一個非常好的方式。

黃仁勳:能快速分享一下你們為什麼創立你們的公司嗎?

Ashish Vaswani:在我們公司,我們的目標是建立模型並解決新的任務。我們的工作是理解任務的目標和內容,並隨著這些內容的變化來滿足客戶的需求。事實上,從2021年開始,我發現模型最大的問題在於,你不能只讓模型變得更聰明,你還需要找到合適的人才來解讀這些模型。我們希望讓這個世界與模型相互交融,使模型變得更加龐大和卓越。學習過程中需要取得一定的進展,最初在實驗室的真空環境下是無法完成這些工作的。

Noam Shazeer:在2021年,我們共同創立了這家公司。我們擁有如此出色的技術,但這項技術並沒有惠及很多人。想像一下,如果我是一個病人,聽到你這樣說,我會覺得有數百億人他們需要完成不同的任務。這就是深度學習的意義所在,我們透過對比來提昇科技。實際上,由於科技的不斷發展,得益於黃仁勳的推動,我們的終極目標是幫助全世界的人們。你們必須進行測試,我們現在需要開發更快的解決方案,讓數百人能夠應用這些應用程式。例如最初,並不是所有人都在使用這些應用,很多人使用它們只是為了娛樂,但它們確實有效,確實在工作。

Jakob Uszkoreit:感謝。我想談談我們創立的生態軟體體系。在2021年,我參與創立了這家公司,我們的目標是解決一些真正具有科學影響力的問題。過去,我們處理的內容相當複雜。但當我迎來第一個孩子時,我看待世界的方式發生了改變。我們希望讓人類的生活變得更便利,也希望對蛋白質的研究做出貢獻。尤其是有了孩子之後,我更希望能夠改變現有的醫療架構,並且希望科學技術的發展能對人類的生存和發展產生正面影響。例如,蛋白質的結構和解構已經受到了一定的影響,但目前我們缺乏數據。我們必須基於數據做出努力,這不僅是職責,也是身為父親的責任。

黃仁勳:我喜歡你的觀點,我總是對新醫藥設計充滿興趣,以及讓電腦學習新藥開發和生成的過程。如果能學習設計新藥,並且有實驗室進行測試,就能確定這樣的模型是否可行。

Llion JonesLlion Jones:是的,我是最後一位分享者。我們共同創立的公司叫做Sakana AI,意思是「魚」。我們之所以用日本的「魚」來命名公司,是因為我們像魚群一樣,自然啟發了我們尋找智慧的靈感。如果我們能將許多檢驗的元素結合起來,就會創造出複雜而美妙的事物。許多人可能不了解這個過程和內容的具體細節,但我們內在的核心哲學是「學習永遠勝利」。

無論你是想解決問題,還是想學習任何內容,學習總是會幫助你取得勝利。在生成式人工智慧的過程中,學習內容也會幫助我們取得勝利。身為在場的研究者,我想提醒大家,我們賦予電腦的AI模型真正的意義,讓它們真正幫助我們理解宇宙的奧秘。實際上,我也想告訴大家,我們即將宣布一項最新的進展,我們對此感到非常興奮。雖然我們現在擁有一系列的研究成果作為基石,但我們正在經歷一種變革性的發展,目前的模型管理是有組織的,它讓人們真正參與其中。我們讓這些模型變得更可行,使用這些大型模型和變革性的模式,改變人們對世界和宇宙的認知方式。這是我們的目標。

Aidan Gomez:我創立公司的初衷與Noam Shazeer相似。我認為電腦正在進入一種新的模式,它正在改變現有的產品和我們的工作方式。一切都基於計算機,而且它在技術內部發生了一定的變化。我們的角色是什麼?我其實是在彌合差距、彌合鴻溝。我們可以看到不同的企業創造這樣的平台,讓每個企業適應並整合產品,這是直接面向使用者的一種方式。這是我們推動科技的方式,我們能讓科技變得更經濟、更普及。

黃仁勳:我特別欣賞的是,當Noam Shazeer顯得特別平靜時,你卻顯得非常興奮。你們倆的個性差異真是鮮明。現在,請Lukasz Kaiser發言。

Lukasz Kaiser:我在OpenAI的經驗非常顛覆性。公司裡充滿了樂趣,我們處理著大量數據進行計算,但歸根究底,我的角色還是個數據處理者。

Illiya Polosukhin:我是第一個離開的人。我堅信我們將取得重大進展,軟體將改變整個世界。最直接的方式就是教會機器編寫程式碼,讓程式設計對每個人都變得可近。

在NEAR,我們的進展雖然有限,但我們致力於整合人類智慧,獲取相關數據,例如進一步啟發人們,並認識到我們需要一種基礎性的方法論。這種模式是基礎性的進展,這種大模型在全球範圍內被廣泛使用,它在航太等領域有許多應用,它關乎各領域的交流與互動,實際上為我們提供了能力。隨著使用的深入,我們發現它帶來了更多的模型,目前並沒有太多關於版權的爭議。

我們現在正處於一個全新的生成式時代,這是一個崇尚創新和創新者的時代,我們希望積極參與並擁抱變化,因此我們尋求不同的方法來幫助建立一個非常酷的模式。

黃仁勳:這種正向的回饋系統對我們整體經濟非常有益。我們現在能夠更好地設計經濟。有人提問,在這個GPT模型正在訓練數十億token規模資料庫的時代,下一步是什麼?新的模型技術將是什麼?你們想要探索什麼?你們的資料來源是什麼?

Illia Polosukhin:我們的起點是向量和位移。我們需要真正具有經濟價值的模型,人們能夠對其進行評估,最終將你的技術和工具應用到實踐中,從而使整個模型變得更好。

黃仁勳:你如何對模型進行領域訓練?最初的互動和互動模式是什麼?是模型之間的交流與互動嗎?還是有生成式的模型和技術?

Illia Polosukhin:在我們團隊中,每個人都有自己的技術專長。

Jakob Uszkoreit:下一步是推理。我們都體認到了推理的重要性,但許多工作目前還是由工程師手工完成的。我們實際上是在教他們以一種互動的問答方式去回答,我們希望他們能夠理解為什麼在一起,一起提供強而有力的推理模式。我們希望模型能夠產生我們想要的內容,這樣的生成方式是我們所追求的。無論是影片、文字或3D訊息,它們都應該被整合在一起。

Lukasz Kaiser:我認為,大家是否理解推理實際上是來自於數據?如果我們開始進行推理,我們手邊有一系列數據,我們會思考這些數據為何與眾不同?然後我們會了解到各種不同的應用,其實都是基於數據推理的過程。由於計算機的能力,由於這樣的系統,我們可以從那裡開始進一步發展。我們可以推理出相關的內容,進行實驗。

很多時候,這些都是源自於數據的。我認為推理的發展非常迅速,數據模型也非常重要,而且不久的將來會有更多互動性的內容。我們還沒有進行充分的培訓,這不是關鍵內容和要素,我們需要讓數據更充實。

Noam Shazeer:設計一些數據,例如設計教學機器,可能涉及數百個、數億個不同的代幣。

Ashish Vaswani:我想提出的一點是,在這一領域,我們有很多合作夥伴,他們取得了一些里程碑式的進展。最好的自動化演算法是什麼?其實是將真實世界的任務分解成不同的內容。我們的模型也非常重要,它幫助我們取得數據,並觀察數據是否處於正確的位置。一方面,它幫助我們專注於數據;另一方面,這樣的數據為我們提供了優質的模型來完成抽象任務。因此,我們認為對這項進展的衡量,也是創意的一種方式,是科學發展的一種方式,也是我們自動化發展的一種方式。

黃仁勳:如果沒有好的衡量體系,就無法完成優秀的工程。你們彼此之間有沒有想問的問題?

Illia Polosukhin:沒有人真正想要了解自己到底走了哪些步驟。但實際上,我們希望能夠了解、探索我們到底在做什麼,獲得足夠的數據和訊息,進行合理的推理。例如,如果你有六步,但實際上你可以透過五步進行推理來跳過一步。有時候你不需要六步,有時候你需要更多步驟,那你要如何重現這樣的場景?你從Token進一步發展需要什麼呢?

Lukasz Kaiser:我個人的信仰是,如何復現這樣的大模型,這是一個非常複雜的過程。系統會不斷進步,但從本質上講,你需要設計一種方法。人類是善於復現的生物,在人類歷史中,我們不斷重現成功的場景。

黃仁勳:很高興能與各位交流,也希望你們有機會相互交流,產生難以言喻的魔法。感謝各位參與這次會議,非常感謝!