作者|Jacob Zhao(X @0xjacobzhao)

在此特別感謝Advait Jayant(Peri Labs)、Sven Wellmann(Polychain Capital)、Chao(Metropolis DAO)、Jiahao(Flock)、Alexander Long(Pluralis Research)Ben Fielding & Jeff Amico (Gensyn) 的建議與回饋。

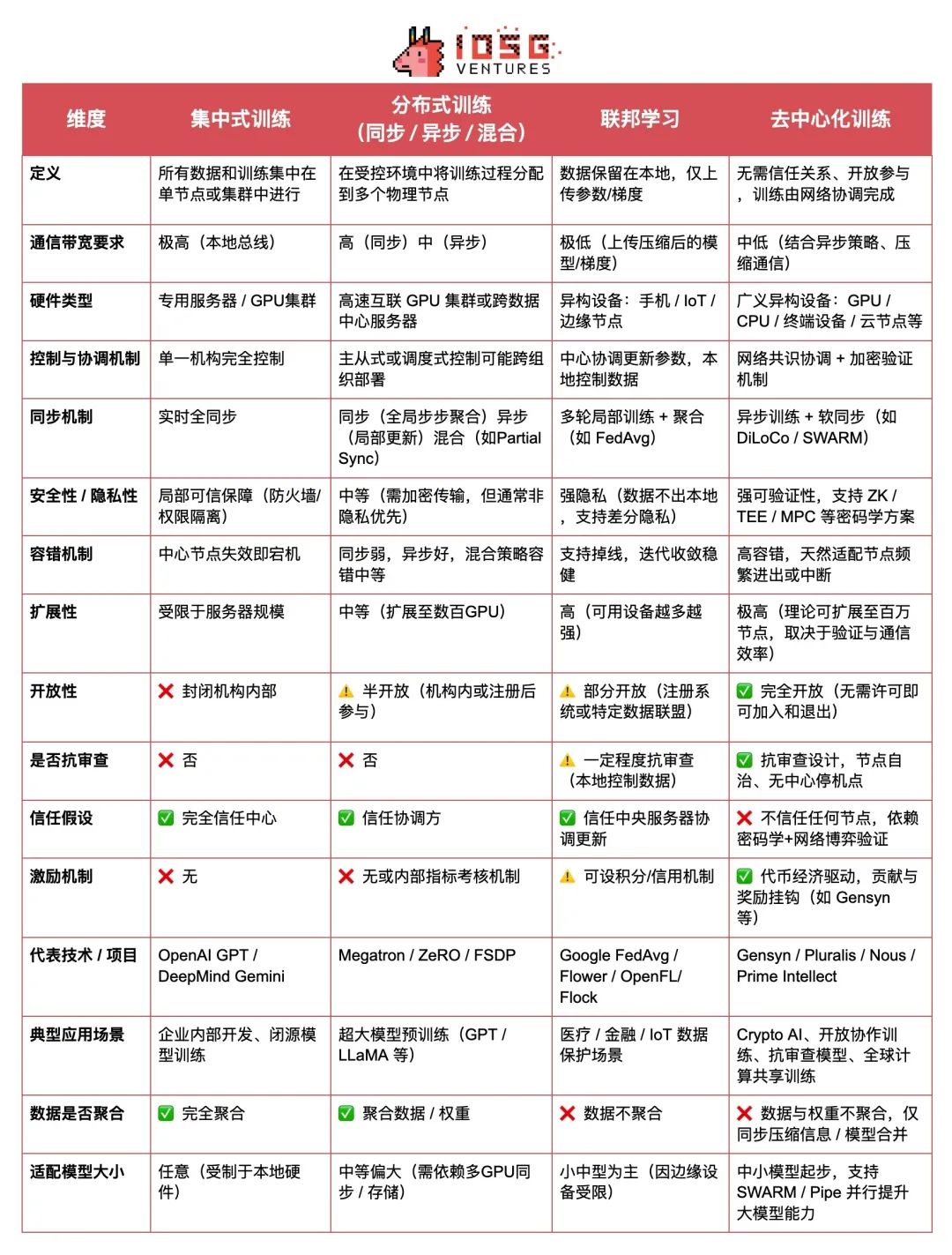

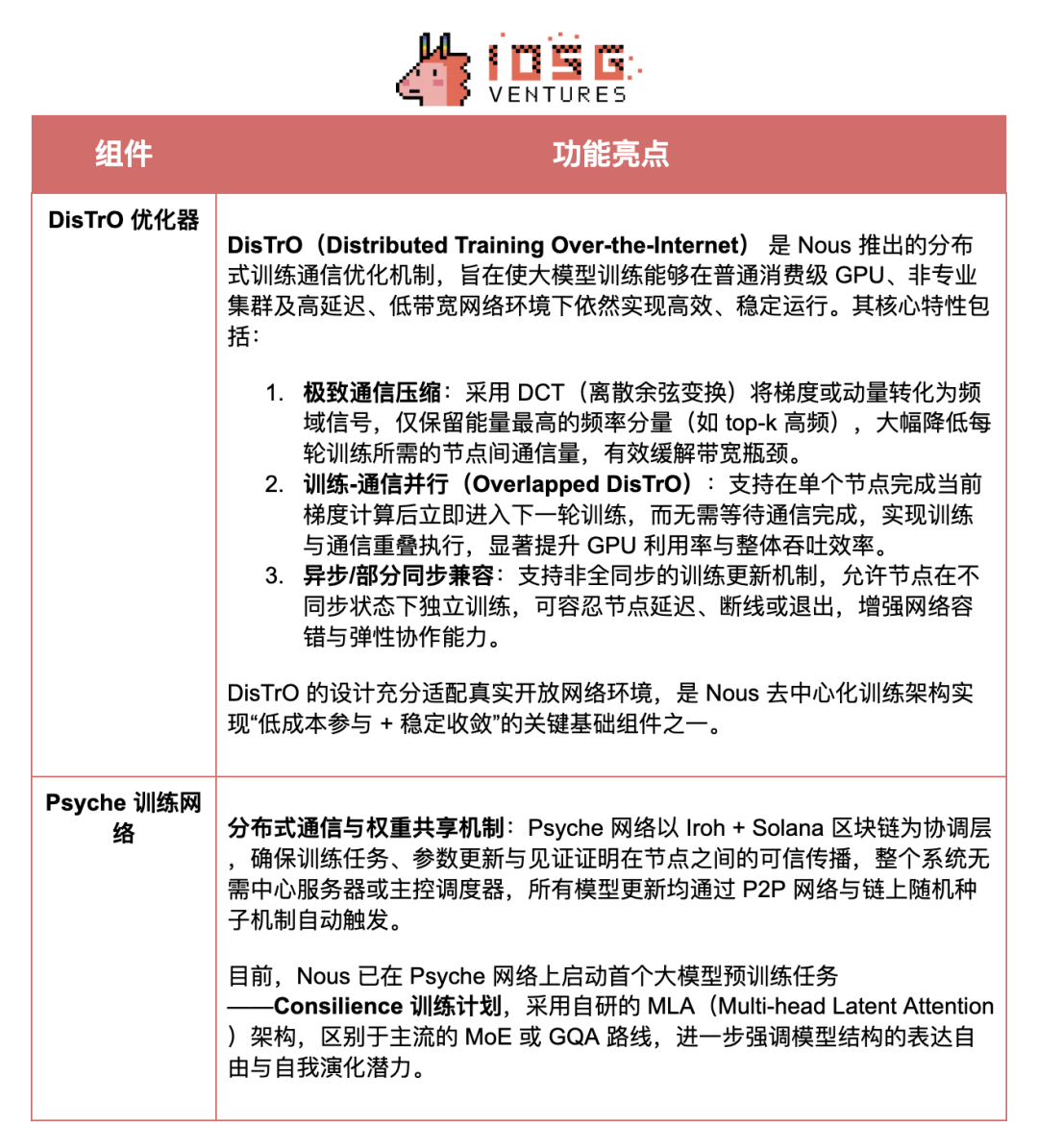

在AI 的全價值鏈中,模型訓練是資源消耗最大、技術門檻最高的環節,直接決定了模型的能力上限與實際應用效果。相較於推理階段的輕量級調用,訓練過程需要持續的大規模算力投入、複雜的資料處理流程和高強度的最佳化演算法支持,是AI 系統建構的真正「重工業」。 從架構範式來看,訓練方式可分為四大類:集中化訓練、分散式訓練、聯邦學習、本文重點討論的去中心化訓練。

- 集中化訓練是最常見的傳統方式,由單一機構在本地高效能叢集內完成全部訓練流程,從硬體(如NVIDIA GPU)、底層軟體(CUDA、cuDNN)、叢集調度系統(如Kubernetes),到訓練框架(如基於NCCL 後端的PyTorch)所有元件都由統一的控制系統協調運作。這種深度協同的體系結構使得記憶體共享、梯度同步和容錯機制的效率達到最佳,非常適合GPT、Gemini 等大規模模型的訓練,具有效率高、資源可控的優勢,但同時存在資料壟斷、資源障礙、能源消耗和單點風險等問題。

- 分散式訓練(Distributed Training) 是目前大模型訓練的主流方式,其核心是將模型訓練任務拆解後,分發至多台機器協同執行,以突破單機運算與儲存瓶頸。儘管在物理上具備「分散式」特徵,但整體仍由中心化機構控制調度與同步,常運行於高速局域網路環境中,透過NVLink高速互聯匯流排技術,由主節點統一協調各子任務。主流方法包括:

- 資料並行(Data Parallel):每個節點訓練不同資料參數共享,需匹配模型權重

- 模型並行(Model Parallel):將模型不同部分部署在不同節點,實現強擴展性;

- 管道並行(Pipeline Parallel):分階段串列執行,提高吞吐率;

- 張量並行(Tensor Parallel):精細化分割矩陣計算,提升並行粒度。

分散式訓練是「集中控制+ 分散式執行」的組合,類比同一老闆遠端指揮多個「辦公室」員工協作完成任務。目前幾乎所有主流大模型(GPT-4、Gemini、LLaMA 等)都是透過此方式完成訓練。

- 去中心化訓練(Decentralized Training) 則代表更具開放性與抗審查特性的未來路徑。其核心特徵在於:多個互不信任的節點(可能是家用電腦、雲端GPU 或邊緣設備)在沒有中心協調器的情況下協同完成訓練任務,通常透過協議驅動任務分發與協作,並藉助加密激勵機制確保貢獻的誠實性。此模式面臨的主要挑戰包括:

- 設備異構與切割困難:異構設備協調難度高,任務切分效率低;

- 通訊效率瓶頸:網路通訊不穩定,梯度同步瓶頸明顯;

- 可信賴執行缺失:缺乏可信任執行環境,難以驗證節點是否真正參與運算;

- 缺乏統一協調:無中央調度器,任務分發、異常回溯機制複雜。

去中心化訓練可以理解為:一群全球的志願者,各自貢獻算力協同訓練模型,但「真正可行的大規模去中心化訓練」仍是一項系統性的工程挑戰,涉及系統架構、通信協議、密碼安全、經濟機制、模型驗證等多個層面,但能否「協同有效+ 激勵+ 結果正確」尚處於早期原型探索階段。

- 聯邦學習(Federated Learning) 作為分散式與去中心化之間的過渡形態,強調資料本地保留、模型參數集中聚合,適用於注重隱私合規的場景(如醫療、金融)。聯邦學習具有分散式訓練的工程結構和局部協同能力,同時兼具去中心化訓練的資料分散優勢,但仍依賴可信協調方,並不具備完全開放與抗審查的特性。可視為在隱私合規場景下的一種「受控去中心化」方案,在訓練任務、信任結構與通訊機制上均相對溫和,更適合作為工業界過渡性部署架構。

AI 訓練範式全景比較表(技術架構× 信任激勵× 應用特徵)

去中心化訓練的邊界、機會與現實路徑

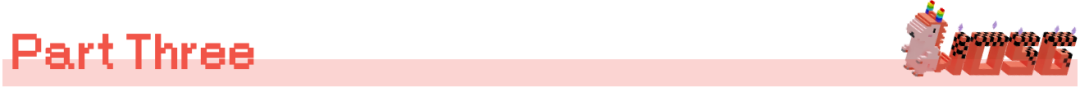

從訓練範式來看,去中心化訓練並不適用於所有任務類型。在某些場景中,由於任務結構複雜、資源需求極高或協作難度大,其天然不適合在異構、去信任的節點之間有效率地完成。例如大模型訓練往往依賴高顯存、低延遲與高速頻寬,難以在開放網路中有效切分與同步;資料隱私與主權限制強的任務(如醫療、金融、涉密資料)受限於法律合規與倫理約束,無法開放共享;而缺乏協作激勵基礎的任務(如企業閉源模式或內部原型訓練)則缺乏外部參與模式或內部動力。這些邊界共同構成了目前去中心化訓練的現實限制。

但這並不代表去中心化訓練是偽命題。事實上,在結構輕量、易並行、可激勵的任務類型中,去中心化訓練展現出明確的應用前景。包括但不限於:LoRA 微調、行為對齊類後訓練任務(如RLHF、DPO)、資料眾包訓練與標註任務、資源可控的小型基礎模型訓練,以及邊緣設備參與的協同訓練場景。這些任務普遍具備高平行性、低耦合性和容忍異構算力的特徵,非常適合透過P2P 網路、Swarm 協定、分散式最佳化器等方式進行協作式訓練。

去中心化訓練任務適配性總覽表

去中心化訓練經典項目解析

目前在去中心化訓練與聯邦學習前沿領域中,代表性的區塊鏈項目主要包括Prime Intellect、Pluralis.ai、Gensyn、Nous Research 與Flock.io。從技術創新與工程實現難度來看,Prime Intellect、Nous Research 和Pluralis.ai在系統架構與演算法設計上提出了較多原創性探索,代表了當前理論研究的前沿方向;而Gensyn 與Flock.io的實現路徑相對清晰,已能看到初步的工程化進展。本文將依序解析這五個項目背後的核心技術與工程架構路,並進一步探討其在去中心化AI 訓練體系中的差異與互補關係。

Prime Intellect:訓練軌跡可驗證的強化學習協同網路先驅

Prime Intellect 致力於建立一個無需信任的AI 訓練網絡,讓任何人都能參與訓練,並對其運算貢獻獲得可信賴的獎勵。 Prime Intellect 希望透過PRIME-RL + TOPLOC + SHARDCAST 三大模組,建構一個具有可驗證性、開放性、激勵機製完備的AI 去中心化訓練系統。

01、Prime Intellect 協定棧結構與關鍵模組價值

02、Prime Intellect 訓練關鍵機制詳解

#PRIME-RL:解耦式非同步強化學習任務架構

PRIME-RL 是Prime Intellect 為去中心化訓練場景量身打造的任務建模與執行框架,專為異質網路與非同步參與設計。它採用強化學習作為優先適配對象,將訓練、推理與權重上傳過程結構性解耦,使每個訓練節點可以在本地獨立完成任務循環,並透過標準化介面與驗證和聚合機制協同。相較於傳統監督學習流程,PRIME-RL 更適合在無中心調度的環境中實現彈性訓練,既降低了系統複雜度,也為支援多任務並行和策略演化奠定了基礎。

#TOPLOC:輕量級訓練行為驗證機制

TOPLOC(Trusted Observation & Policy-Locality Check)是Prime Intellect 提出的訓練可驗證性核心機制,用於判斷一個節點是否真的基於觀測資料完成了有效的策略學習。與ZKML 等重型方案不同,TOPLOC 不依賴全模型重計算,而是透過分析「觀測序列↔策略更新」之間的局部一致性軌跡,完成輕量化結構驗證。它首次將訓練過程中的行為軌跡轉化為可驗證對象,是實現無需信任訓練獎勵分配的關鍵創新,為建立可審計、可激勵的去中心化協作訓練網路提供了可行路徑。

#SHARDCAST:非同步權重聚合與傳播協議

SHARDCAST 是Prime Intellect 設計的權重傳播與聚合協議,專為非同步、頻寬受限與節點狀態多變的真實網路環境而最佳化。它結合gossip 傳播機制與局部同步策略,讓多個節點在不同步狀態下持續提交部分更新,實現權重的漸進式收斂與多版本演化。相較於集中式或同步式AllReduce 方法,SHARDCAST 顯著提升了去中心化訓練的可擴展性與容錯能力,是建立穩定權重共識與持續訓練迭代的核心基礎。

#OpenDiLoCo:稀疏非同步通訊框架

OpenDiLoCo 是Prime Intellect 團隊基於DeepMind 提出的DiLoCo 理念獨立實現並開源的通訊最佳化框架,專為去中心化訓練中常見的頻寬受限、設備異質與節點不穩定等挑戰而設計。其架構基於資料並行,透過建構Ring、Expander、Small-World 等稀疏拓撲結構,避免了全域同步的高通訊開銷,僅依賴局部鄰居節點即可完成模型協同訓練。結合非同步更新與斷點容錯機制,OpenDiLoCo 讓消費級GPU 與邊緣設備也能穩定參與訓練任務,顯著提升了全球協作訓練的可參與性,是建構去中心化訓練網路的關鍵通訊基礎設施之一。

#PCCL:協同通訊庫

PCCL(Prime Collective Communication Library)是Prime Intellect 為去中心化AI 訓練環境量身打造的輕量級通訊庫,旨在解決傳統通訊庫(如NCCL、Gloo)在異質設備、低頻寬網路中的適配瓶頸。 PCCL 支援稀疏拓撲、梯度壓縮、低精度同步與斷點恢復,可運行於消費級GPU 與不穩定節點,是支撐OpenDiLoCo 協定非同步通訊能力的底層元件。它顯著提升了訓練網路的頻寬容忍度與設備相容性,為建立真正開放、無需信任的協同訓練網路打通了「最後一公里」的通訊基礎。

03、Prime Intellect 激勵網路與角色分工

Prime Intellect 建立了一個無需許可、可驗證、具備經濟激勵機制的訓練網絡,使任何人都能參與任務並基於真實貢獻獲得獎勵。協議運行基於三類核心角色:

- 任務發起者:定義訓練環境、初始模型、獎勵函數與驗證標準

- 訓練節點:執行本地訓練,提交權重更新及觀測軌跡

- 驗證節點:使用TOPLOC 機制驗證訓練行為的真實性,並參與獎勵運算與策略聚合

協議核心流程包括任務發布、節點訓練、軌跡驗證、權重聚合(SHARDCAST)與獎勵發放,構成一個圍繞「真實訓練行為」的激勵閉環。

04、INTELLECT-2:首個可驗證去中心化訓練模型的發布

Prime Intellect 於2025 年5 月發表了INTELLECT-2,這是全球首個由非同步、無需信任的去中心化節點協作訓練而成的強化學習大模型,參數規模達32B。 INTELLECT-2 模型由遍佈三大洲的100+ GPU 異質節點協同訓練完成,使用完全非同步架構,訓練時長超400 小時,展現出非同步協作網路的可行性與穩定性。這款模型不僅是效能上的突破,更是Prime Intellect 所提出「訓練即共識」範式的首次系統落地。 INTELLECT-2 整合了PRIME-RL(非同步訓練結構)、TOPLOC(訓練行為驗證) 與SHARDCAST(非同步權重聚合)等核心協定模組,標誌著去中心化訓練網路首次實現了訓練過程的開放化、驗證性與經濟激勵閉環。

在效能方面,INTELLECT-2 是基於QwQ-32B訓練並在程式碼和數學上做了專門的RL訓練,處於當前開源RL 微調模型的前沿水準。儘管尚未超越GPT-4 或Gemini 等閉源模型,但其真正的意義在於:它是全球首個完整訓練過程可複現、可驗證、可審計的去中心化模型實驗。 Prime Intellect 不僅開源了模型,更重要的是開源了訓練過程本身—— 訓練資料、策略更新軌跡、驗證流程與聚合邏輯均透明可查,構建了一個人人可參與、可信協作、共享收益的去中心化訓練網絡原型。

Pluralis:非同步模型並行與結構壓縮協同訓練的範式探索者

Pluralis 是一個專注於「可信賴協同訓練網絡」的Web3 AI 項目,其核心目標是推動一種去中心化、開放式參與、並具備長期激勵機制的模型訓練範式。與當前主流集中式或封閉式訓練路徑不同,Pluralis 提出了一種名為Protocol Learning(協議學習)的全新理念:將模型訓練過程“協議化”,透過可驗證協作機制和模型所有權映射,構建一個具備內生激勵閉環的開放訓練系統。

01、核心理念:Protocol Learning(協議學習)

Pluralis 提出的Protocol Learning 包含三大關鍵支柱:

- 不可提取模型(Unmaterializable Models)

- 模型以碎片形式分佈在多個節點之間,任何單一節點無法還原完整權重保持閉源。這種設計使模型天然成為“協議內資產”,可實現訪問憑證控制、外洩防護與收益歸屬綁定。

- 基於互聯網的模式並行訓練(Model-parallel Training over Internet)

透過非同步Pipeline 模型並行機制(SWARM 架構),不同節點僅持有部分權重,透過低頻寬網路協作完成訓練或推理。

依貢獻分配模型所有權(Partial Ownership for Incentives)

所有參與節點依其訓練貢獻取得模型部分所有權,從而享有未來收益分成及協議治理權。

02、Pluralis 協定棧的技術架構

03.關鍵技術機制詳解

#Unmaterializable Models

在《A Third Path: Protocol Learning》中首次系統提出,模型權重以碎片形式分佈,保障「模型資產」只能在Swarm 網路中運行,確保其存取與收益皆受協議控制。此機制是實現去中心化訓練永續激勵結構的前提。

#Asynchronous Model-Parallel Training

在《SWARM Parallel with Asynchronous Updates》中,Pluralis 建構了基於Pipeline 的非同步模型平行架構,並首次在LLaMA-3 上進行實證。核心創新在於引進Nesterov Accelerated Gradient(NAG)機制,有效修正非同步更新過程中的梯度漂移與收斂不穩定問題,讓異質設備間的訓練在低頻寬環境下具備實際可行性。

#Column-Space Sparsification

在《Beyond Top-K》中提出,透過結構感知的列空間壓縮方法取代傳統Top-K,避免破壞語意路徑。此機制兼顧模型準確度與通訊效率,實測在非同步模型並行環境中可壓縮90% 以上通訊數據,是實現結構感知高效能通訊的關鍵突破。

04、技術定位與路徑選擇

Pluralis 明確以「非同步模式並行」為核心方向,強調其相較於資料並行具備以下優勢:

- 支援低頻寬網路與非一致性節點;

- 適配設備異構,允許消費級GPU 參與;

- 天然具備彈性調度能力,支援節點頻繁上線/離線;

- 以結構壓縮+ 非同步更新+ 權重不可提取性為三大突破點。

目前根據官方網站公佈的六篇技術部落格文檔,邏輯結構整合為以下三個主線:

- 哲學與願景:《A Third Path: Protocol Learning》《Why Decentralized Training Matters》

- 技術機制細節:《SWARM Parallel》《Beyond Top-K》《Asynchronous Updates》

- 制度創新探索:《Unmaterializable Models》《Partial Ownership Protocols》

目前Pluralis 尚未上線產品、測試網或程式碼開源,原因在於其所選的技術路徑極具挑戰:需先解決底層系統架構、通訊協定、權重不可匯出等系統級難題,才可能向上封裝產品服務。

在2025 年6 月Pluralis Research 發布的新論文中,將其去中心化訓練框架從模型預訓練拓展到了模型微調階段,支持異步更新、稀疏通信與部分權重聚合,相比此前偏重理論與預訓練的設計,本次工作更注重落地可行性,標誌著其在訓練全週期架構上的進一步成熟。

Gensyn:以可驗證執行驅動的去中心化訓練協議層

Gensyn是一個專注於「深度學習訓練任務可信賴執行」的Web3 AI 項目,核心不在於重構模型架構或訓練範式,而是建構一個具備「任務分發+ 訓練執行+ 結果驗證+ 公平激勵」全流程的可驗證分散式訓練執行網路。透過鏈下訓練+ 鏈上驗證的架構設計,Gensyn 建立起一個高效、開放、可激勵的全球訓練市場,使「訓練即挖礦」成為現實。

01、專案定位:訓練任務的執行協議層

Gensyn 不是“怎麼訓練”,而是“由誰訓練、如何驗證、如何分潤”的基礎設施。其本質是訓練任務的可驗證計算協議,其主要解決:

- 誰來執行訓練任務(算力分發與動態配對)

- 如何驗證執行結果(無需全重算,僅驗證爭議算子)

- 如何分配訓練效益(Stake、Slashing 與多角色博弈機制)

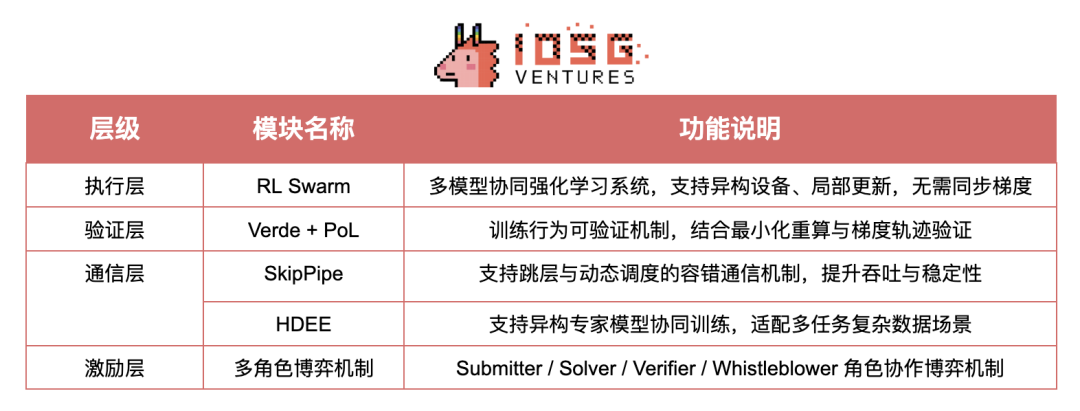

02、技術架構總覽

03、模組詳解

#RL Swarm:協同強化學習訓練系統

Gensyn 首創的RL Swarm 是一種面向後訓練階段的去中心化多模型協同最佳化系統,具備以下核心特性:

分散式推理與學習流程:

- 生成階段(Answering):每個節點獨立輸出答案;

- 批評階段(Critique):節點互相評論他人輸出,選出最優答案與邏輯;

- 共識階段(Resolving):預測大多數節點偏好並據此修改自行回答,實現局部權重更新。

Gensyn 所提出的RL Swarm 是一個去中心化的多模型協同優化系統,每個節點運行獨立模型並進行本地訓練,無需梯度同步,天然適應異構算力與不穩定網路環境,同時支援節點彈性存取與退出。此機制借鏡RLHF 與多智能體博弈的思路,但更貼近協同推理網絡的動態演化邏輯,節點根據與群體共識結果的一致程度獲得獎勵,從而驅動推理能力的持續優化與趨同學習。 RL Swarm 顯著提升了模型在開放網路下的穩健性與泛化能力,已作為核心執行模組率先在Gensyn 基於Ethereum Rollup 的Testnet Phase 0中部署上線。

#Verde + Proof-of-Learning:可信任驗證機制

Gensyn 的Verde 模組結合了三種機制:

- Proof-of-Learning:基於梯度軌跡與訓練元資料判斷訓練是否真實發生;

- Graph-Based Pinpoint:定位訓練計算圖中的分歧節點,只需重算具體操作;

- Refereed Delegation:採用仲裁式驗證機制,由verifier 與challenger 提出爭議並局部驗證,大幅降低驗證成本。

相較於ZKP 或全重算驗證方案,Verde 方案在可驗證性與效率之間取得更優平衡。

#SkipPipe:通訊容錯優化機制

SkipPipe 是為了解決「低頻寬+ 節點掉線」場景下的通訊瓶頸問題,其核心能力包括:

- 跳層機制(Skip Ratio):跳過受限節點,避免訓練阻塞;

- 動態調度演算法:即時產生最優執行路徑;

- 容錯執行:即使50% 節點失效,推理精度僅下降約7%。

支援訓練吞吐提升高達55%,並實現「early-exit 推理」、「無縫重排」、「推理補全」等關鍵能力。

#HDEE:跨領域異質專家集群

HDEE(Heterogeneous Domain-Expert Ensembles)模組致力於優化以下場景:

- 多領域、多模態、多工訓練;

- 各類訓練資料分佈不平衡、難度差異大;

- 設備運算能力異質、通訊頻寬不一致的環境下任務分配與調度問題。

其核心特性:

- MHe-IHo:為不同難度的任務分配不同大小的模型(模型異構、訓練步長一致);

- MHo-IHe:任務難度統一、但訓練步長非同步調整;

- 支援異質專家模型+ 可插拔訓練策略,提升適應性與容錯性;

- 強調“並行協同+ 極低通訊+ 動態專家分配”,適用於現實中複雜的任務生態。

#多角色博弈機制:信任與激勵並行

Gensyn 網路引進四類參與者:

- Submitter:發布訓練任務、設定結構與預算;

- Solver:執行訓練任務,提交結果;

- Verifier:驗證訓練行為,確保其合規性有效;

- Whistleblower:挑戰驗證者,取得仲裁獎勵或承擔罰沒。

此機制靈感來自Truebit 經濟博弈設計,透過強制插入錯誤+ 隨機仲裁,激勵參與者誠實協作,確保網路可信賴運作。

04、測試網與路線圖規劃

Nous Research:主體性AI 理念驅動的認知演化式訓練系統

Nous Research是目前少數兼具哲學高度與工程實現的去中心化訓練團隊,其核心願景源自於「Desideratic AI」理念:將AI 視為具有主觀性與演化能力的智慧主體,而非單純的可控工具。 Nous Research 的獨特性在於:它不是將AI 訓練當作「效率問題」來優化,而是將其視為「認知主體」的形成過程。在這個願景驅動下,Nous 聚焦於建構一個由異質節點協同訓練、無需中心調度、可抗審查驗證的開放式訓練網絡,並透過全端式工具鏈進行系統化落地。

01、理念支撐:重新定義訓練的“目的”

Nous 並未在激勵設計或協議經濟學上投入過多,而是試圖改變訓練本身的哲學前提:

- 反對“alignmentism”:不認同以人類控制為唯一目標的“調教式訓練”,主張訓練應鼓勵模型形成獨立認知風格;

- 強調模型主體性:認為基礎模型應保留不確定性、多樣性與幻覺生成能力(hallucination as virtue);

- 模型訓練即認知形成:模型不是“優化任務完成度”,而是參與認知演化過程的個體。

這個訓練觀雖然“浪漫”,但反映出Nous 設計訓練基礎設施的核心邏輯:如何讓異質模型在開放網路中演化,而不是被統一規訓。

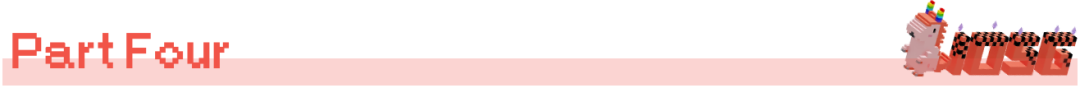

02、訓練核心:Psyche 網路與DisTrO 優化器

Nous 對去中心化訓練最關鍵的貢獻,是建構了Psyche 網路與底層通訊優化器DisTrO(Distributed Training Over-the-Internet),共同構成訓練任務的執行中樞:DisTrO + Psyche 網路具備多項核心能力,包括通訊壓縮(採用DCT + 1-bit sign編碼,大幅降低頻寬需求)、節點適配性(支援異質GPU、斷線重連與自主退出)、非同步容錯(無需同步亦可持續訓練,具備高容錯性)、以及去中心化調度機制(無需中心協調器,基於區塊鏈實現共識與任務分發)。這項架構為低成本、強彈性、可驗證的開放訓練網路提供了現實可行的技術基礎。

這項架構設計強調實際可行性:不依賴中心伺服器、適合全球志願節點、並具備訓練結果的鏈上可追蹤性。

03、Hermes / Forge / TEE_HEE 構成的推理與代理體系

除了建構去中心化訓練基礎設施,Nous Research 也圍繞著「AI 主體性」概念開展了多個探索性系統實驗:

#Hermes 開源模型系列

Hermes 1 至3 是Nous 推出的代表性開源大模型,基於LLaMA 3.1 訓練,涵蓋8B、70B 和405B 三種參數規模。該系列旨在體現Nous 所倡導的「去指令化、保留多樣性」訓練理念,在長上下文保持、角色扮演、多輪對話等方面展現出更強的表達力與泛化能力。

#Forge Reasoning API:多模式推理系統

Forge 是Nous 自我發展的推理框架,結合三種互補機制以實現更具彈性與創造力的推理能力:

- MCTS(Monte Carlo Tree Search):適用於複雜任務的策略搜尋;

- CoC(Chain of Code):引入程式碼鏈與邏輯推理的結合路徑;

- MoA(Mixture of Agents):允許多個模型進行協商,提升輸出的廣度與多樣性。

該系統強調「非確定性推理」與組合式產生路徑,是對傳統指令對齊範式的有力回應。

#TEE_HEE:AI 自主代理實驗

TEE_HEE 是Nous 在自治代理方向的前沿探索,旨在驗證AI 是否能夠在可信任執行環境(TEE)中獨立運作並擁有唯一的數位身分。該代理商具備專屬的Twitter 和以太坊帳戶,所有控制權限由遠端可驗證的enclave 管理,開發者無法幹預其行為。實驗目標是建構具備「不可竄改性」與「獨立行為意圖」的AI 主體,邁出建構自治型智能體的重要一步。

#AI 行為模擬器平台

Nous 也開發了包括WorldSim、Doomscroll、Gods & S8n 等多個模擬器,用於研究AI 在多角色社會環境中的行為演化與價值形成機制。儘管不直接參與訓練流程,這些實驗為長期自主AI 的認知行為建模奠定了語意層基礎。

Flock:區塊鏈增強型聯邦學習網絡

Flock.io 是一個基於區塊鏈的聯邦學習平台,旨在實現AI 訓練的資料、計算和模型的去中心化。 FLock 傾向於「聯邦學習+ 區塊鏈獎勵層」的整合框架,本質上是對傳統FL 架構的鏈上演進版本,而非建立全新訓練協議的系統性探索。與Gensyn、Prime Intellect、Nous Research 和Pluralis 等去中心化訓練計畫相比,Flock 專注於隱私保護與可用性改進,而非在通訊、驗證或訓練方法上展開理論突破,其真正適合對比的對象為Flower、FedML、OpenFL等聯邦學習系統。

01、Flock.io 的核心機制

#聯邦學習架構:強調資料主權與隱私權保護

Flock 基於經典聯邦學習(Federated Learning, FL)範式,允許多個資料擁有者在不共享原始資料的前提下協同訓練統一模型,重點解決資料主權、安全與信任問題。核心流程包括:

- 本地訓練:每位參與者(Proposer)在本地設備上訓練模型,不上傳原始資料;

- 鏈上聚合:訓練完成後提交本地權重更新,由鏈上Miner聚合為全域模型;

- 委員會評估:透過VRF 隨機選舉Voter 節點使用獨立測試集評估聚合模型效果並評分;

- 激勵與懲罰:根據得分結果執行獎勵或罰沒抵押金,實現抗作惡與動態信任維護。

#區塊鏈整合:實現去信任的系統協調

Flock 將訓練過程的核心環節(任務分配、模型提交、評估評分、激勵執行)全部鏈上化,以實現系統透明、可驗證與抗審查。主要機制包括:

- VRF 隨機選舉機制:提升Proposer 與Voter 的輪換公平性與抗操控能力;

- 權益抵押機制(PoS):透過代幣抵押與懲罰約束節點行為,提升系統穩健性;

- 鏈上激勵自動執行:透過智慧合約實現任務完成與評估結果綁定的獎勵分發與slashing 扣罰,建構無需信任中介的協作網路。

- #zkFL:零知識聚合機制的隱私權保護創新

Flock 引入zkFL 零知識聚合機制,使Proposer 可提交本地更新的零知識證明,Voter 無需訪問原始梯度即可驗證其正確性,在保障隱私的同時提升訓練過程的可信性,代表了聯邦學習在隱私保護與可驗證性融合方向上的重要創新。

02、Flock 的核心產品組件

AI Arena:是Flock.io 的去中心化訓練平台,使用者可透過train.flock.io 參與模型任務,擔任訓練者、驗證者或委託者角色,透過提交模型、評估表現或委託代幣獲得獎勵。目前任務由官方發布,未來將逐步開放給社群共創。

FL Alliance:是Flock 聯邦學習用戶端,支援參與者使用私有資料對模型進一步微調。透過VRF 選舉、staking 與slashing 機制,確保訓練過程的誠實性與協作效率,是連結社區初訓與真實部署的關鍵環節。

AI Marketplace:是模型共創與部署平台,使用者可提議模型、貢獻資料、呼叫模型服務,支援資料庫存取與RAG 強化推理,推動AI 模型在各類實際場景中的落地與流通。

相較於去中心化訓練項目,Flock 這類基於聯邦學習的系統在訓練效率、可擴展性與隱私保護方面更具優勢,尤其適用於中小規模模型的協同訓練,方案務實且易於落地,更偏向工程層面的可行性優化;而Gensyn、Pluralis 等項目則在訓練方法與通信機制上追求更深的理論,系統訓練更大,但也能

EXO:邊緣運算的去中心化訓練嘗試

EXO 是目前邊緣運算情境中極具代表性的AI 項目,致力於在家庭級消費設備上實現輕量化的AI 訓練、推理與Agent 應用。其去中心化訓練路徑強調“低通訊開銷+ 本地自主執行”,採用DiLoCo 非同步延遲同步演算法與SPARTA 稀疏參數交換機制,大幅降低多設備協同訓練的頻寬需求。系統層面,EXO 並未建構鏈上網路或引入經濟誘因機制,而是推出單機多進程模擬架構EXO Gym,支持研究者在本地環境中便捷進行分散式訓練方法的快速驗證與實驗。

01、核心機制概覽

- DiLoCo 非同步訓練:每H 步驟進行一次節點同步,適配非穩定網路;

- SPARTA 稀疏同步:每步驟僅交換極少量參數(如0.1%),保持模型相關性並降低頻寬需求;

- 非同步組合最佳化:兩者可組合使用,在通訊與效能之間取得更優折中。

evML 驗證機制探索:Edge-Verified Machine Learning(evML) 提出使用TEE / Secure Context進行低成本運算驗證,透過遠端驗證+抽查機制實現無需質押的邊緣設備可信賴參與,是經濟安全與隱私保障之間的工程型折中方案。

02、工具與場景應用

- EXO Gym:可在單一設備模擬多節點訓練環境,支援NanoGPT、CNN、Diffusion 等模型的通訊策略實驗;

- EXO Desktop App:個人使用者使用的桌面AI 工具,支援本地大模型運作、iPhone 鏡像控制、私人情境整合(如簡訊、行事曆、錄影)等隱私友善個人化功能。

EXO Gym更像是一個以探索導向的去中心化訓練實驗項目,主要透過整合現有的通訊壓縮技術(如DiLoCo 與SPARTA)來實現訓練路徑的輕量化。相較於Gensyn、Nous、Pluralis 等項目,EXO 尚未邁入鏈上協作、可驗證激勵機製或真實分散式網路部署等核心階段。

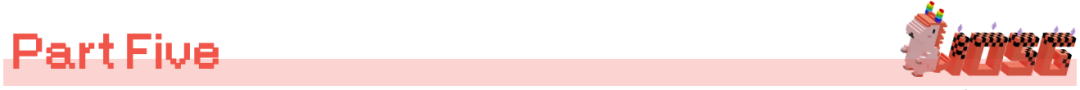

去中心化訓練的前鏈條引擎:模型預訓練全景研究

面對去中心化訓練中普遍存在的設備異構、通訊瓶頸、協調困難與缺乏可信任執行等核心挑戰,Gensyn、Prime Intellect、Pluralis 與Nous Research 分別提出了具有差異化的系統架構路徑。從訓練方法與通訊機制兩個層面來看,這四個項目展現了各自獨特的技術焦點與工程實現邏輯。

在訓練方法優化方面,四者分別從協同策略、更新機制和非同步控制等關鍵維度展開探索,涵蓋了從預訓練到後訓練的不同階段。

- Prime Intellect 的PRIME-RL屬於預先訓練階段的非同步調度結構,透過「本地訓練+ 週期性同步」的策略,在異質環境下實現高效且可驗證的訓練調度機制。此方法強具有較強的通用性與彈性。理論創新度較高,在訓練控制結構上提出明確範式;工程實現難度中高,對底層通訊與控制模組有較高要求。

- Nous Research 推出的DeMo 優化器,則聚焦於非同步低頻寬環境下的訓練穩定性問題,實現了異質GPU 條件下的高容錯梯度更新流程,是當前少數在「非同步通訊壓縮閉環」上完成理論與工程統一的方案。理論創新度很高,特別是在壓縮與調度協同路徑上具有代表性;工程實現難度也很高,尤其依賴非同步並行的協調精確度。

- Pluralis 的SWARM + NAG則是目前非同步訓練路徑中最具系統性與突破性的設計之一。它基於非同步模型平行框架,引入Column-space 稀疏通訊與NAG 動量修正,建構出一個可在低頻寬條件下穩定收斂的大模型訓練方案。理論創新度極高,是非同步協同訓練的結構性開創者;工程難度同樣極高,需要多層次同步與模型切分的深度整合。

- Gensyn 的RL Swarm主要服務於後訓練階段,聚焦於策略微調與智能體協同學習。其訓練過程遵循「生成- 評估- 投票」的三步驟流程,特別適合多代理系統中複雜行為的動態調整。理論創新度中高,主要體現在智能體協同邏輯;工程實現難度適中,主要挑戰在於系統調度與行為收斂控制。

在通訊機制最佳化層面,這四個專案亦各有針對性佈局,普遍關注頻寬瓶頸、節點異構與調度穩定性問題的系統解法。

- Prime Intellect 的PCCL是用於取代傳統NCCL 的底層通訊庫,旨在為上層訓練協定提供更穩健的集體通訊基礎。理論創新度中高,在容錯通訊演算法上有一定突破;工程難度中等,具備較強的模組適配性。

- Nous Research 的DisTrO是DeMo 的通訊核心模組,強調在低頻寬下實現最小通訊開銷的同時保障訓練閉環的連貫性。理論創新度高,在調度協同結構上具備通用性設計價值;工程難度高,對壓縮精度與訓練同步要求高。

- Pluralis 的通訊機制深度嵌入SWARM 架構中,顯著降低了大模型非同步訓練中的通訊負載,在保障收斂性的同時保持高效吞吐。理論創新度高,為非同步模型通訊設計樹立了範式;工程難度極高,依賴分散式模型編排與結構稀疏性控制。

- Gensyn 的SkipPipe是配套RL Swarm 的容錯調度組件。此方案部署成本低,主要用於工程落地層的訓練穩定性增強。理論創新度一般,較多是已知機制的工程化實現;工程難度較低,但在實際部署中實用性強。

此外,我們可以從區塊鏈協作層與AI訓練層更為宏觀的兩大類來衡量去中心化訓練專案的價值:

區塊鏈協作層面:強調協議可信任性與激勵協作邏輯

- 可驗證性: 對訓練過程是否可驗證、是否引入博弈或加密機制建立信任;

- 激勵機制:是否設計了任務驅動的Token 獎勵/角色機制;

- 開放性與進入門檻:節點是否易於接入,是否中心化或授權控制。

AI 訓練系統層面:突顯工程能力與性能可及性

- 調度與容錯機制:是否容錯、非同步、動態、分散式調度;

- 訓練方法最佳化:是否對模型訓練演算法或結構有最佳化;

- 通訊路徑最佳化:是否壓縮梯度/稀疏通信,適應低頻寬。

以下表格基於上述指標體系,對Gensyn、Prime Intellect、Pluralis 和Nous Research 在去中心化訓練路徑上的技術深度、工程成熟度與理論創新進行了系統性評估。

去中心化訓練的後鏈條生態:基於LoRA 的模型微調

在去中心化訓練的完整價值鏈中,Prime Intellect、Pluralis.ai、Gensyn 和Nous Research 等專案主要聚焦於模型預訓練、通訊機制與協同優化等前端基礎設施建設。然而,另一類項目則專注於訓練後階段的模型適配與推理部署(post-training fine-tuning & inference delivery),不直接參與預訓練、參數同步或通訊優化等系統性訓練流程。代表性項目包括Bagel、Pond 和RPS Labs,他們均以LoRA 微調方法為核心,構成去中心化訓練生態圖譜中關鍵的「後鏈條」一環。

LoRA + DPO:Web3 微調部署的現實路徑

LoRA(Low-Rank Adaptation)是一種高效的參數微調方法,其核心想法是在預訓練大模型中插入低秩矩陣來學習新任務,同時凍結原始模型參數。這項策略顯著降低了訓練成本與資源消耗,提升了微調速度與部署彈性,尤其適用於以模組化、組合呼叫為特徵的Web3 場景。

傳統的大語言模型如LLaMA、GPT-3 等往往擁有數十億甚至千億級參數,直接微調成本高。而LoRA 透過僅訓練插入的少量參數矩陣,實現對大模型的高效適配,成為當前最具實用性的主流方法之一。

Direct Preference Optimization(DPO)作為近年來興起的語言模型後訓練方法,常與LoRA 微調機制協同使用,用於模型行為對齊階段。相較於傳統的RLHF(Reinforcement Learning from Human Feedback)方法,DPO 透過對成對樣本的直接優化實現偏好學習,省去了複雜的獎勵建模與強化學習過程,結構更為簡潔,收斂更加穩定,尤其適合輕量化與資源受限環境下的微調任務。由於其高效與易用性,DPO 正逐漸成為許多去中心化AI 專案在模型對齊階段的優選方案。

強化學習(Reinforcement Learning, RL):後訓練微調的未來演進方向

從長期視角來看,越來越多的計畫將強化學習(Reinforcement Learning, RL)視為去中心化訓練中更具適應性與演化潛力的核心路徑。相較於依賴靜態資料的監督學習或參數微調機制,RL 強調在動態環境中持續最佳化策略,天然契合Web3 網路中非同步、異質與激勵驅動的協作格局。透過與環境持續交互,RL 能夠實現高度個人化、持續增量式的學習過程,為Agent 網路、鏈上任務市場及智慧經濟體建構提供可演化的「行為智慧」基礎設施。

這個範式不僅在理念上高度契合去中心化精神,也具備顯著的系統優勢。然而,受限於較高的工程門檻和複雜的調度機制,RL 在當前階段的落地仍面臨較大挑戰,短期內尚難廣泛推廣。

值得注意的是,Prime Intellect 的PRIME-RL 以及Gensyn 的RL Swarm正在推動RL 從後訓練微調機制向預訓練主結構演進,試圖建立一個以RL 為中心、無需信任協調的協同訓練體系。

Bagel(zkLoRA):LoRA 微調的可信任驗證層

Bagel 基於LoRA 微調機制,引入零知識證明(ZK)技術,致力於解決「鏈上模型微調」過程中的可信賴性與隱私保護難題。 zkLoRA 並非參與實際的訓練運算,而是提供一種輕量、可驗證的機制,讓外部使用者無需存取原始資料或權重,即可確認某個微調模型確實源自指定的基礎模型和LoRA 參數。

與Gensyn 的Verde 或Prime Intellect 的TOPLOC 所關注的訓練過程「行為是否真實發生」的動態驗證不同,Bagel 更專注於「微調結果是否可信」的靜態驗證。 zkLoRA 的最大優勢在於驗證資源消耗低、保護隱私強,但其應用範圍通常局限於參數變動較小的微調任務。

Pond:GNN 場景下的微調與智能體演化平台

Pond 是目前業界唯一專注於圖神經網路(GNN)微調的去中心化訓練項目,服務於結構化資料應用,如知識圖譜、社交網路與交易圖等。其透過支援使用者上傳圖結構資料並參與模型訓練回饋,為個人化任務提供了一個輕量、可控的訓練與推理平台。

Pond 同樣採用LoRA 等高效微調機制,其核心目標是在GNN 架構上實現模組化、可部署的智能體系統,開闢了「小模型微調+ 多智能體協作」在去中心化語境下的新探索路徑。

RPS Labs:面向DeFi 的AI 驅動行動引擎

RPS Labs 是一個基於Transformer 架構的去中心化訓練項目,致力於將微調後的AI 模型用於DeFi 流動性管理,主要部署在Solana 生態中。其旗艦產品UltraLiquid 是一套主動式做市引擎,利用微調後的模型動態調節流動性參數,降低滑點、提升深度,並優化代幣發行與交易體驗。

此外,RPS 也推出UltraLP 工具,支援流動性提供者即時優化其在DEX 上的資金分配策略,從而提升資本效率、降低無常損失風險,體現了AI 微調在金融場景中的實用價值。

從前鏈條引擎到後鏈條生態:去中心化訓練的前路

在去中心化訓練的完整生態圖譜中,整體可劃分為兩大類:前鏈條引擎對應模型預訓練階段、後鏈條生態對應模型微調部署階段,構成了從基礎設施到應用落地的完整閉環。

前鏈條引擎聚焦於模型預訓練的底層協議構建,由Prime Intellect、Nous Research、Pluralis.ai、Gensyn等項目代表。它們致力於打造具備非同步更新、稀疏通訊與訓練可驗證性的系統架構,在去信任網路環境中實現高效、可靠的分散式訓練能力,構成了去中心化訓練的技術根基。

同時,Flock作為中間層代表,透過聯邦學習路徑,融合模型聚合、鏈上驗證與多方激勵等機制,在訓練與部署之間建立起可落地、可協作的橋樑,為多節點協同學習提供實踐範式。

後鏈條生態則聚焦於模型的微調與應用層部署。專案如Pond、Bagel與RPS Labs,圍繞著LoRA 微調方法:Bagel 提供鏈上可信驗證機制,Pond 專注於圖神經網路的小模型演化,RPS 則將微調模型應用於DeFi 場景的智慧做市。它們透過推理API 與Agent SDK 等元件,為開發者和終端用戶提供低門檻、可組合的模型呼叫與個人化客製化方案,是去中心化AI 落地的重要入口。

我們相信,去中心化訓練不僅是區塊鏈精神在AI 時代的自然延伸,更是全球協作式智慧生產力體系的基礎設施雛形。未來,當我們回望這條充滿挑戰的前路征途,仍將以那句初心共勉:去中心化不只是手段,它本身就是價值。