著者: MITからの抜粋

編集:フェリックス、PANews

OpenAIのChatGPTをはじめとする大規模言語モデル(LLM)製品の普及に伴い、世界中の企業や人々がLLMをほぼ毎日利用しています。他のツールと同様に、LLMにも独自の利点と限界があります。

マサチューセッツ工科大学(MIT)は最近、206ページに及ぶ研究報告書を発表しました。この報告書では、教育現場で論文執筆のためのLLM(ChatGPTなど)を使用することによる認知コストを調査し、LLMの使用が脳と認知能力に与える影響を明らかにしています。この研究は、OpenAIのChatGPTなどの人工知能チャットボットへの過度の依存が認知能力を低下させる可能性があることを示しました。

研究チームは参加者をLLMグループ、検索エンジングループ、脳のみグループの3つのグループに分けました。参加者は指定されたツール(脳のみグループはツールを使用しませんでした)を使用し、4ヶ月間の限られた時間内に論文を執筆しました。論文のトピックは実験ごとに異なりました。研究チームは参加者ごとに同じグループ分けで3ラウンドの実験を行いました。4ラウンド目の実験では、LLMグループの参加者にはツールを一切使用しないように依頼し(LLM-to-brainグループ)、脳のみグループの参加者にはLLMを使用させました(brain-to-LLMグループ)。最初の3ラウンドの実験には合計54名の参加者が参加し、そのうち18名が4ラウンド目の実験を完了しました。

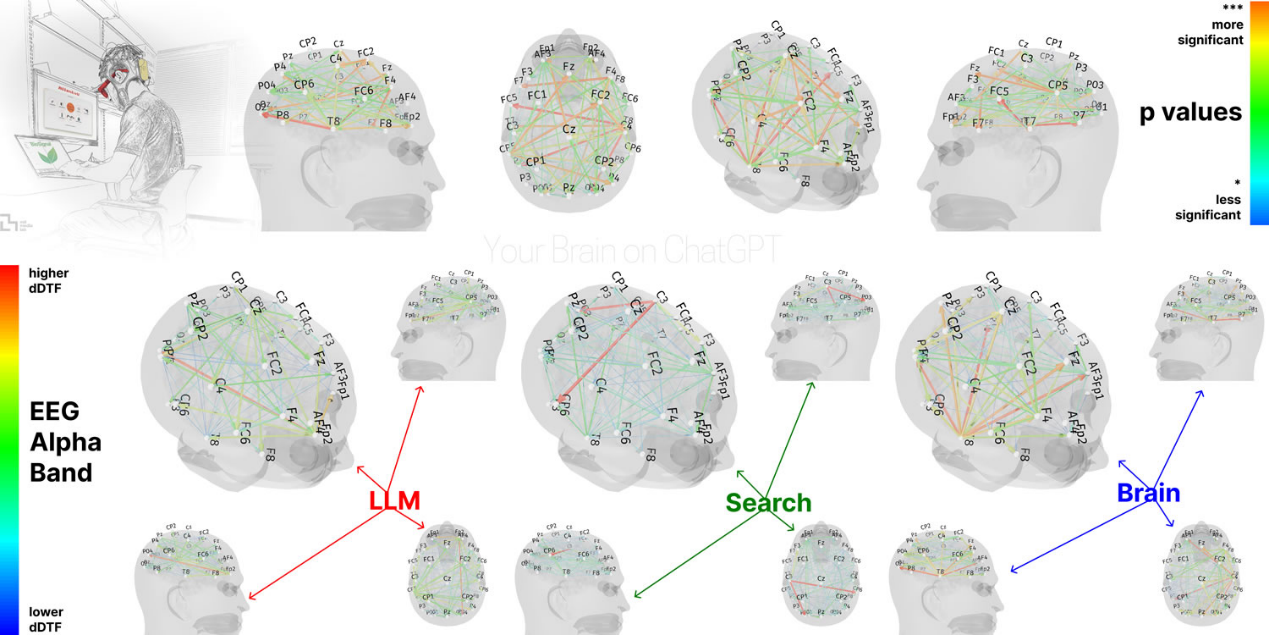

研究チームは、脳波(EEG)を用いて参加者の脳の電気活動を記録し、認知的関与と認知負荷を評価し、エッセイライティング課題中の神経活動に関する知見を得ました。また、自然言語処理(NLP)分析を実施し、各実験後に各参加者にインタビューを行いました。採点は、人間の教師とAI審査員(特別に構築されたAIエージェント)の協力を得て行いました。

自然言語処理(NLP)分析では、脳のみを使った参加者は、ほとんどのトピックにおいて記事の書き方に大きなばらつきが見られました。対照的に、法学修士(LLM)グループが各トピックについて書いた記事は、統計的に均質性が高く、他のグループと比較して有意にばらつきが少なかった傾向がありました。検索エンジングループは、少なくとも部分的には、検索エンジンのプロモーションと最適化されたコンテンツの影響を受けた可能性があります。

LLM グループは、人、名前、場所、年、定義など、最も具体的な名前付きエンティティ (NER) を使用しました。検索エンジン グループは LLM グループの少なくとも半分の NER を使用しました。脳のみのグループは LLM グループよりも 60% 少ない NER を使用しました。

LLMグループと検索エンジングループに所属する人々は、限られた時間(20分)というプレッシャーから、使用するツールの出力結果に集中しがちでした。彼らの多くは、ツールの出力結果を再利用することに注力し、独自のアイデアを取り入れ、独自の視点と経験に基づいて編集するのではなく、コピー&ペーストに追われていました。

神経接続パターンに関しては、研究者らは動的方向性伝達関数 (dDTF) 法を使用して参加者の認知負荷を測定しました。dDTF は、実行機能、意味処理、注意制御に重要なネットワークの一貫性における体系的かつ周波数固有の変化を明らかにすることができます。

脳波解析の結果、LLM群、検索エンジン群、脳のみ群の間で神経接続パターンに有意な差が見られ、これは異なる認知戦略を反映している。脳接続の程度は、外部支援の増加に伴い系統的に低下した。脳のみ群は最も強力かつ広範なネットワークを示し、検索エンジン群は中程度の関与を示し、LLM支援群は全体的な結合が最も弱かった。

実験の第4ラウンドでは、LLMから脳のみに移行した参加者は神経接続が弱くなり、アルファおよびベータネットワークの関与が低下したのに対し、脳のみからLLMに移行した参加者は記憶想起が改善され、後頭頭頂葉および前頭前野の広範な結節の再活性化が見られました。

インタビューでは、LLMグループは論文に対する所有権意識が低いことが分かりました。検索エンジングループは所有権意識は強かったものの、脳のみのグループほどではありませんでした。LLMグループは数分前に書いた論文を引用する能力においても遅れをとっており、ChatGPTユーザーの83%以上が数分前に書いた論文を引用することができませんでした。

この研究はまだ査読を受けていないが、LLM群の参加者は、4ヶ月間の研究期間中、脳のみを使った対照群と比較して、神経、言語、スコアのレベルで成績が悪かったことが示された。一般の人々におけるLLMの教育的影響は現れ始めたばかりであるため、AI LLMの使用は、特に若年層において、学習スキルの向上を阻害する可能性がある。

研究者らは、LLMが人間にとって有益であると認識される前に、AIチャットボットが人間の脳に及ぼす長期的な影響を理解するための「長期的研究」が必要だと述べた。

ChatGPTがこの研究についてどう考えているか尋ねられたとき、同社は次のように回答した。「この研究は、ChatGPTが本質的に有害であると言っているわけではありません。むしろ、考えも努力もせずにChatGPTに過度に依存しないように警告しているのです。」

関連記事: a16z:AIエージェント、DePINからマイクロペイメントまで、暗号化とAIの統合に向けた11の主要な実装方向